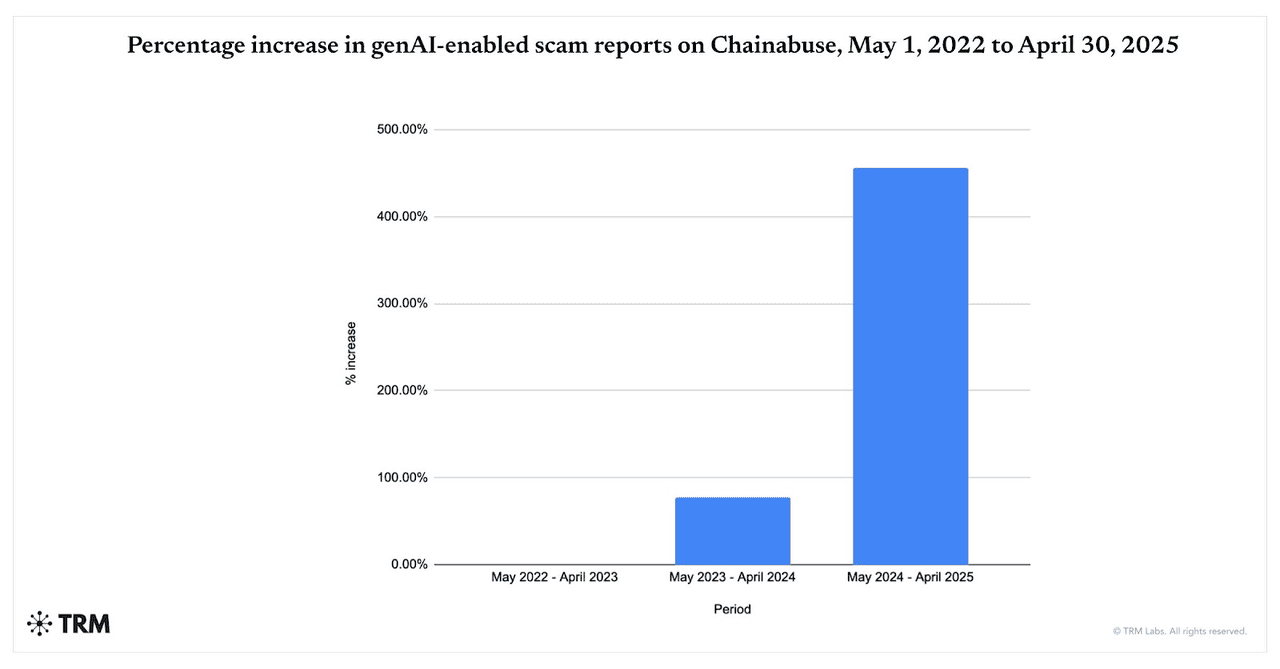

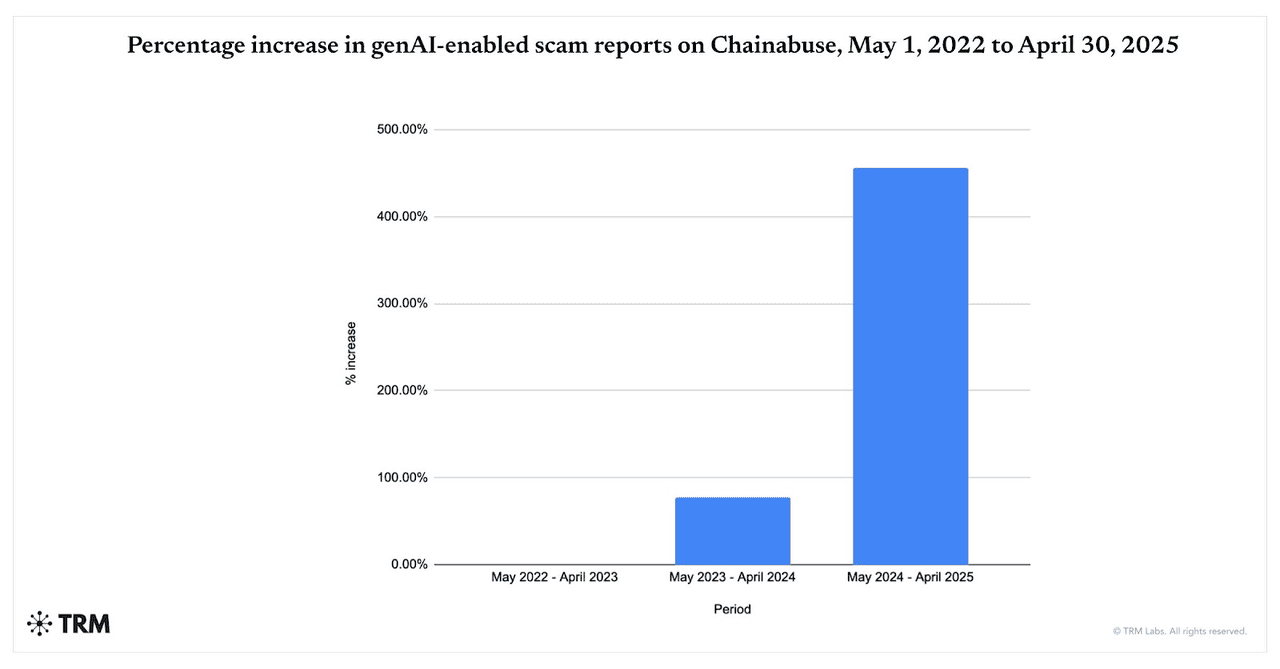

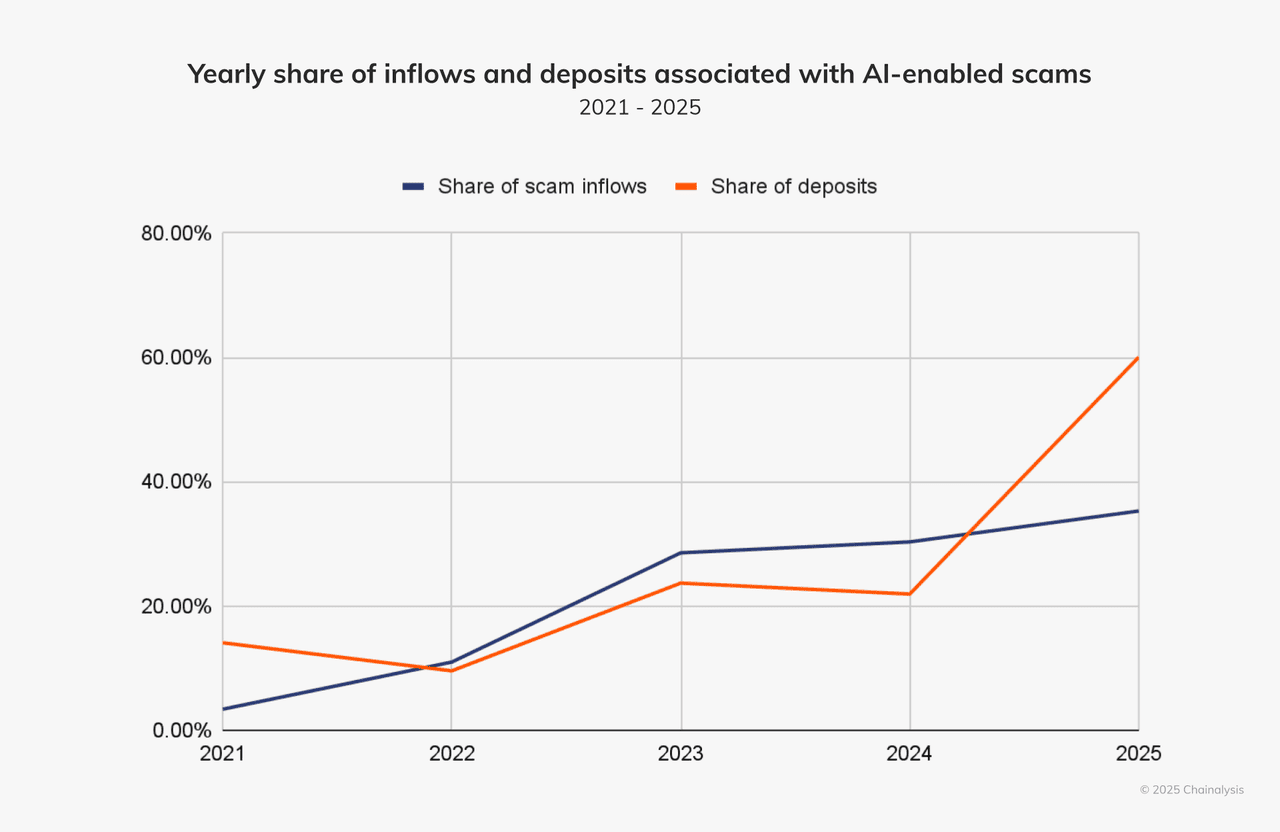

El fraude impulsado por IA está en aumento, y rápidamente. Según TRM Labs, entre mayo de 2024 y abril de 2025, los informes sobre fraudes habilitados por IA generativa aumentaron un 456%. Chainalysis también descubrió que el 60% de los depósitos en billeteras fraudulentas ahora involucran herramientas de IA. Este es un gran aumento desde poco más del 20% en 2024.

El aumento de los fraudes habilitados por IA de 2022 a 2025 | Fuente: TRM Labs

¿Qué está detrás de esta explosión? La IA ahora le da a los estafadores velocidad, escala y realismo. Un solo estafador puede desplegar miles de bots de

phishing, crear videos de deepfake y suplantar marcas confiables, todo sin escribir una sola línea de código.

¿Y las criptomonedas? Son el objetivo perfecto. Operas en un mundo descentralizado y en constante movimiento con transacciones irreversibles. Esto facilita que los estafadores ataquen y hace que sea más difícil para ti recuperarte.

En esta guía, aprenderás qué son los fraudes con IA en criptomonedas, cómo funcionan y cómo mantenerte seguro al usar plataformas de trading, incluyendo BingX.

¿Qué son los fraudes en criptomonedas impulsados por IA?

Los fraudes en criptomonedas impulsados por IA utilizan

inteligencia artificial para engañarte y hacer que entregues tu dinero, claves privadas o información de inicio de sesión. Estos fraudes van más allá del phishing tradicional. Son más inteligentes, rápidos y más creíbles que nunca.

Los fraudes tradicionales en criptomonedas a menudo dependen de tácticas manuales. Piensa en correos electrónicos falsos con mala gramática o esquemas básicos de sorteos en redes sociales. Son fáciles de identificar si sabes qué buscar.

Pero la IA cambia las reglas del juego. Los estafadores ahora utilizan el aprendizaje automático y la IA generativa para:

1. Crear contenido realista y personalizado que se sienta humano

Las herramientas de IA crean correos electrónicos de phishing y mensajes falsos que suenan naturales. Imitan el tono humano, usan una gramática impecable e incluso agregan toques personales basados en tu actividad en línea. Estos mensajes se sienten reales, no robóticos. Eso los hace mucho más difíciles de detectar que los correos electrónicos fraudulentos del pasado.

Los videos deepfake y las copias de voz van más allá. Un estafador ahora puede copiar el rostro y la voz de alguien con una precisión aterradora. Puedes ver un video o escuchar una llamada y realmente creer que proviene de un CEO, influencer o amigo.

2. Lanzar ataques masivos a la velocidad de la luz

La IA ayuda a los estafadores a moverse rápido. Con solo algunos comandos, pueden generar miles de mensajes de phishing en segundos. Cada mensaje puede ser personalizado, localizado y enviado a través de múltiples plataformas, como correo electrónico, Telegram, Discord e incluso SMS.

Ese nivel de escala solía requerir equipos completos. Ahora, un solo estafador con las herramientas de IA adecuadas puede apuntar a miles de usuarios al mismo tiempo.

3. Superar los filtros tradicionales y los sistemas de seguridad

Los fraudes con IA también superan los filtros de seguridad tradicionales. Los sistemas antiguos buscan errores de ortografía, mala gramática o enlaces de phishing conocidos. Pero el contenido generado por IA no comete esos errores. Se adapta rápidamente. Usa nuevos dominios, rota enlaces e incluso inserta caracteres invisibles para engañar a los filtros.

Los sistemas heredados de detección de fraudes no pueden mantenerse al día. Por eso, los fraudes impulsados por IA a menudo se escapan.

Estos ataques son más convincentes porque imitan cómo las personas realmente hablan, escriben y actúan. También son más fáciles de escalar. Con herramientas como WormGPT o FraudGPT, un solo atacante puede lanzar miles de fraudes en minutos.

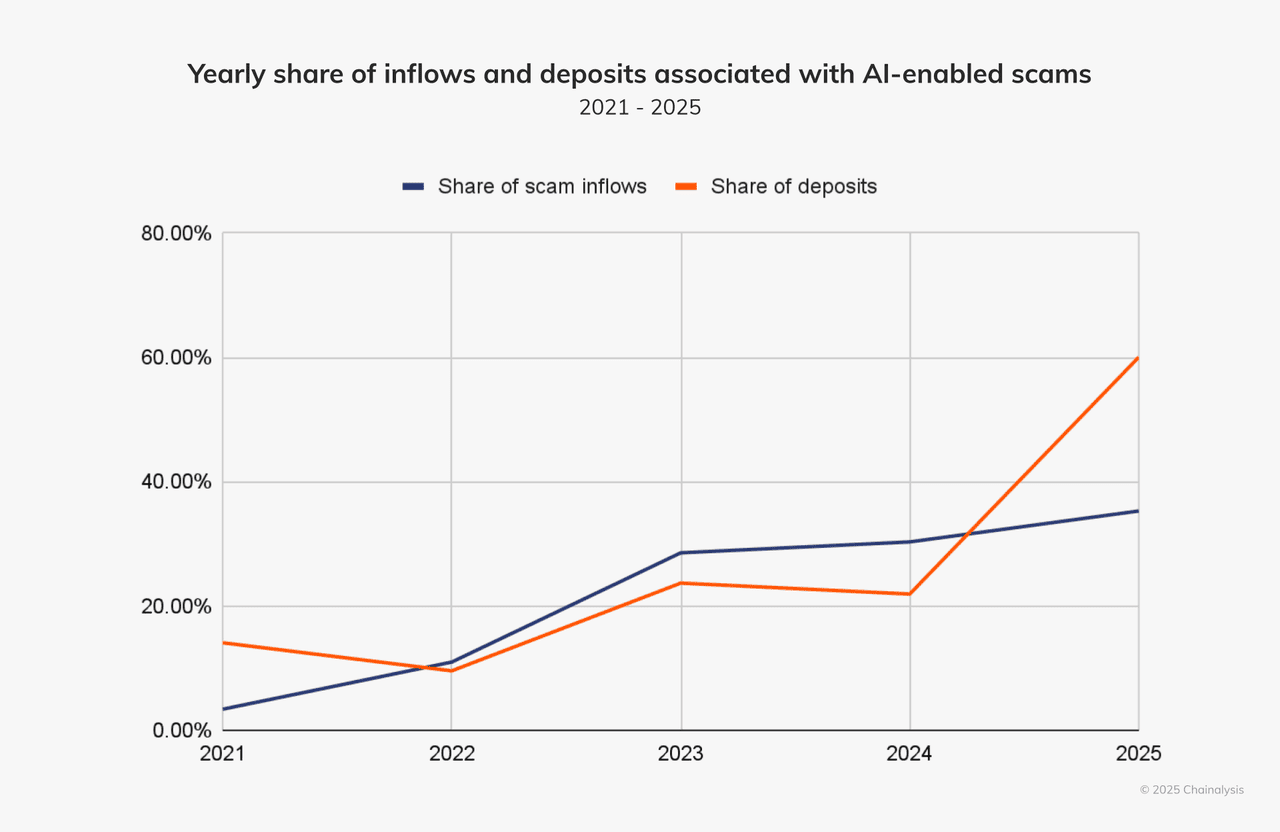

Los flujos y depósitos de estafas con IA están en aumento | Fuente: Chainalysis

Según Chainalysis, aproximadamente el 60% de todos los depósitos en carteras fraudulentas ahora provienen de operaciones que utilizan herramientas de IA. Esa cifra es tres veces mayor que la del año pasado.

La IA le da una ventaja a los estafadores, pero no tienes que ser su próxima víctima. Aprender cómo funcionan estas estafas es el primer paso para mantenerte seguro.

Tipos comunes de estafas en criptomonedas impulsadas por IA

Las estafas en criptomonedas impulsadas por IA vienen en muchas formas. Algunas te engañan con voces o videos falsos. Otras usan chatbots para ganarse tu confianza o crean aplicaciones de trading falsas que parecen legítimas.

Veamos los tipos más comunes y casos reales que muestran lo peligrosas que se han vuelto.

1. Estafas de Deepfake

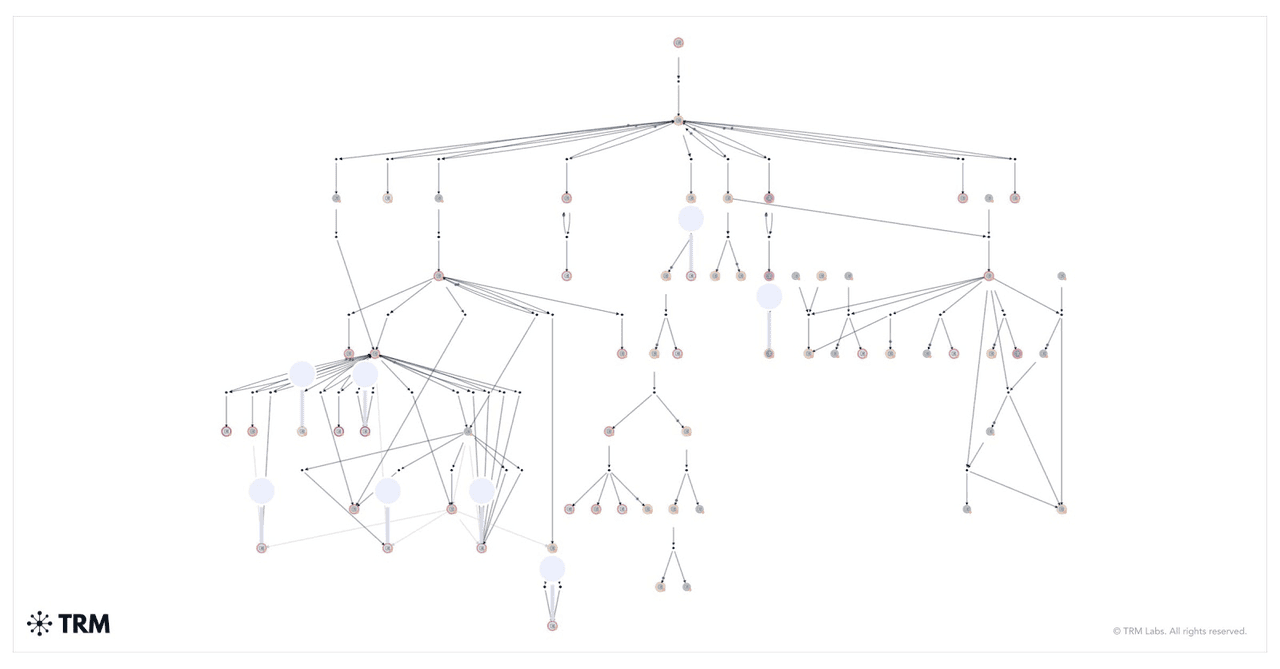

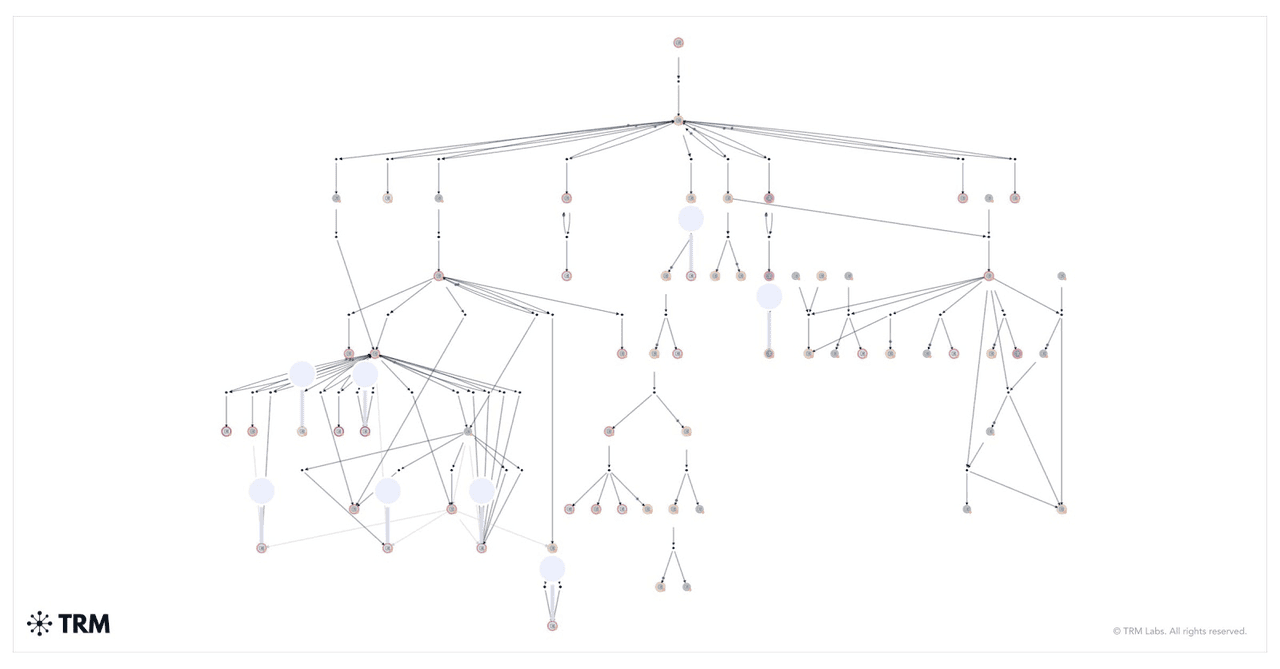

Cómo se movieron los fondos de una estafa de Deepfake | Fuente: TRM Labs

Las estafas de Deepfake utilizan videos o clips de audio generados por IA para hacerse pasar por figuras públicas, influencers o incluso ejecutivos de tu propia empresa. Los estafadores manipulan las expresiones faciales y los patrones de voz para hacer que el contenido parezca real. Estos videos falsos suelen promover sorteos fraudulentos de criptomonedas o pedirte que envíes fondos a direcciones de carteras específicas.

Uno de los casos más alarmantes ocurrió a principios de 2024. Un empleado de finanzas de una empresa multinacional en Hong Kong se unió a una videollamada con lo que parecía ser el CFO y los ejecutivos senior de la empresa. Le indicaron que transfiriera 25 millones de dólares. Era una trampa. La llamada era un Deepfake, y todos los rostros y voces fueron generados por IA. El empleado no se dio cuenta hasta que fue demasiado tarde.

Esta misma táctica se está utilizando para hacerse pasar por líderes tecnológicos como Elon Musk. En una estafa, los videos Deepfake de Musk promovían un sorteo de Bitcoin. Se les decía a los espectadores que enviaran

BTC a una

billetera y recibir el doble de la cantidad de vuelta. Chainalysis rastreó una sola billetera que recolectó millones de dólares durante una transmisión en vivo falsa en YouTube.

2. Phishing generado por IA

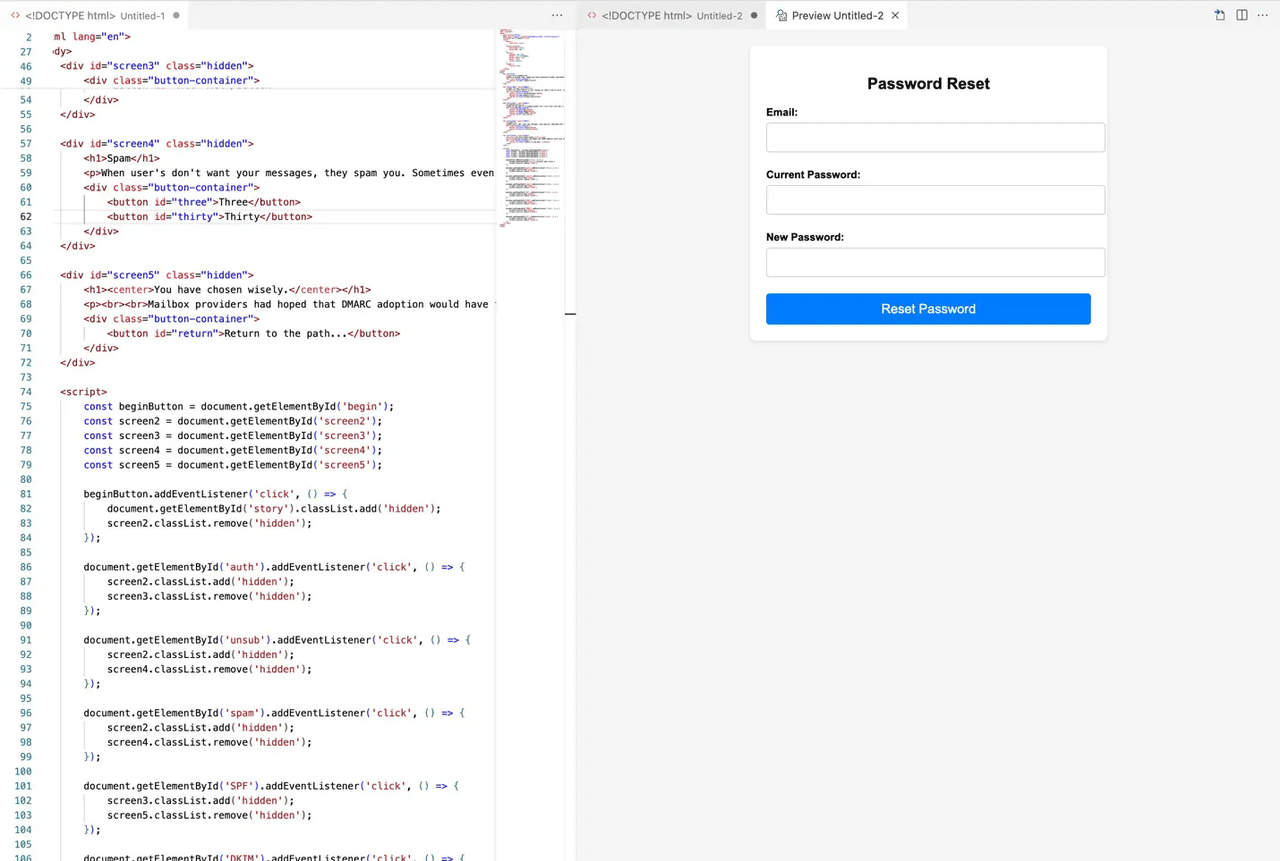

Ejemplo de un sitio web de phishing generado por IA | Fuente: MailGun

El phishing ha evolucionado con la ayuda de la IA. En lugar de gramática torpe y enlaces sospechosos, estos mensajes parecen reales y se sienten personales. Los estafadores usan la IA para recopilar datos públicos sobre ti y luego crean correos electrónicos, mensajes directos o incluso sitios web completos que coinciden con tus intereses y comportamientos.

El fraude podría llegar a través de Telegram, Discord, correo electrónico o incluso LinkedIn. Podrías recibir un mensaje que imita al soporte de BingX, instándote a "verificar tu cuenta" o "reclamar una recompensa". El enlace te lleva a una página falsa que se ve casi idéntica a la real. Ingresa tu información y el juego habrá terminado.

TRM Labs informó un aumento del 456% en los intentos de phishing generado por IA en solo un año. Estos ataques ahora usan grandes modelos de lenguaje (LLMs) para imitar el tono humano y adaptarse a diferentes idiomas. Algunos estafadores incluso utilizan IA para eludir las verificaciones de

KYC, generar credenciales falsas o simular chats en vivo con "agentes de soporte".

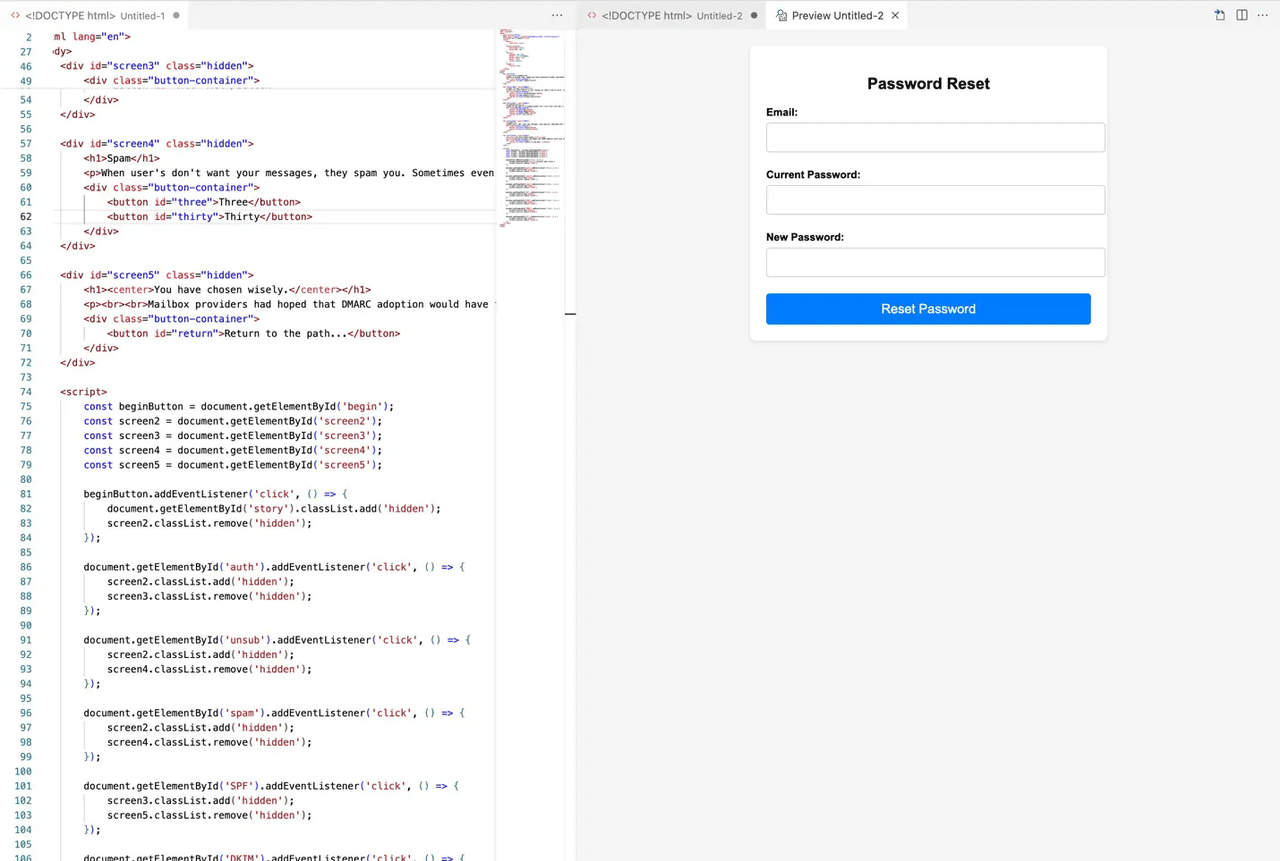

3. Plataformas de trading y bots de IA falsos

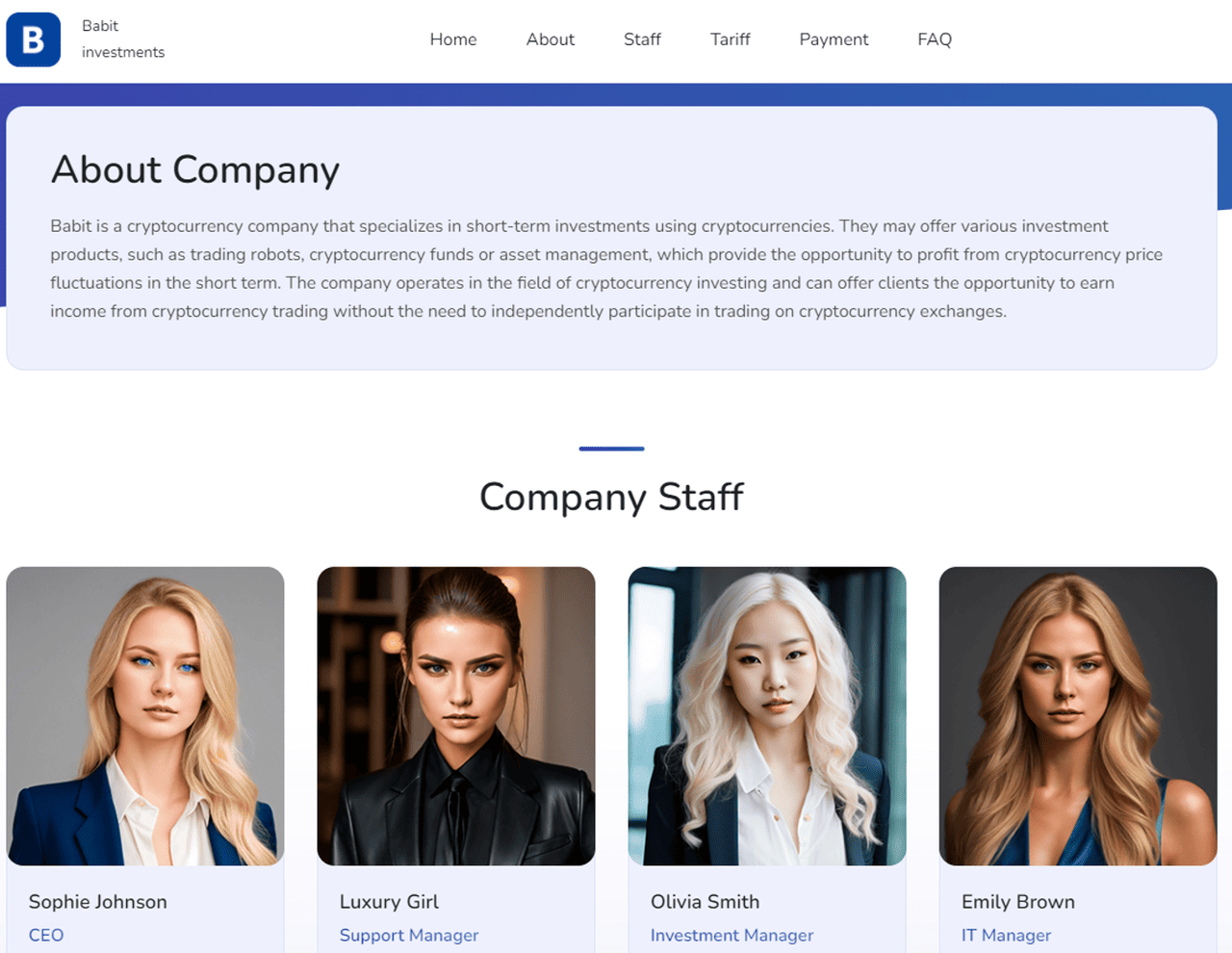

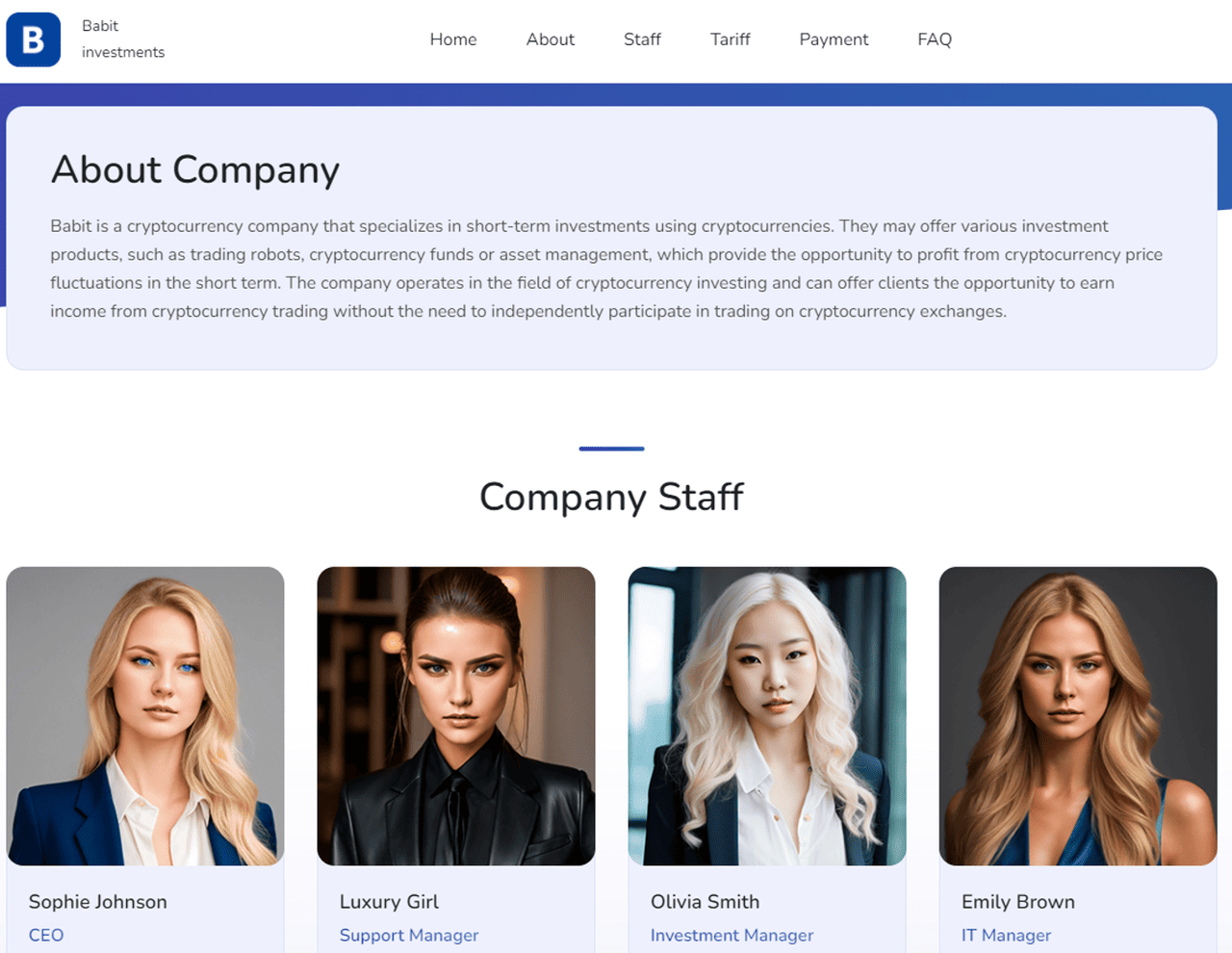

Cómo MetaMax utilizó IA para crear una empresa falsa con empleados falsos | Fuente: TRM Labs

Los estafadores también crean plataformas de trading completas que afirman usar IA para obtener ganancias automáticas. Estas herramientas falsas prometen rendimientos garantizados, ejecución de operaciones "inteligente" o tasas de éxito imbatibles. Pero una vez que depositas tu criptomoneda, desaparece.

Estas estafas a menudo parecen legítimas. Presentan paneles de control elegantes, gráficos en vivo y testimonios, todo impulsado por imágenes y códigos generados por IA. Algunos incluso ofrecen operaciones de demostración para falsificar el rendimiento. En 2024, sitios como MetaMax utilizaron avatares de IA de CEOs falsos para generar confianza y atraer a usuarios desprevenidos.

En realidad, no hay ninguna estrategia impulsada por IA detrás de estas plataformas, solo una trampa bien diseñada. Una vez que los fondos entran, descubrirás que no puedes retirar nada. Algunos usuarios informan que sus billeteras fueron vaciadas después de conectarlas a estos sitios. Los bots de IA también envían "señales" en Telegram o Twitter para empujarte hacia operaciones arriesgadas o inexistentes.

4. Clonación de voz y llamadas en tiempo real

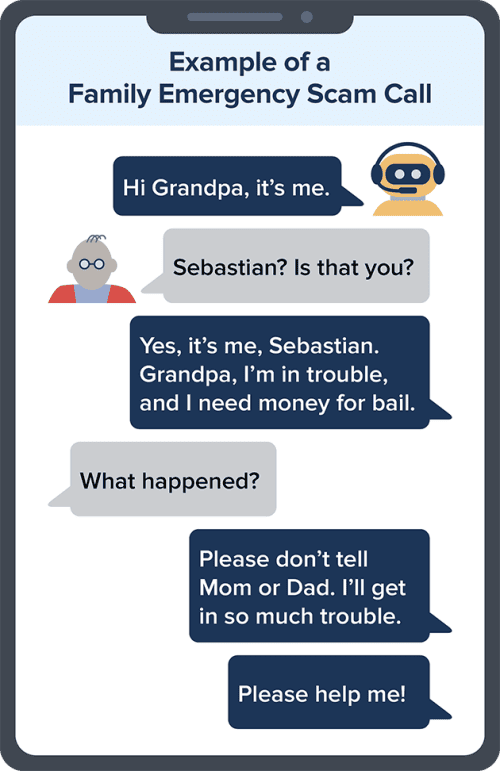

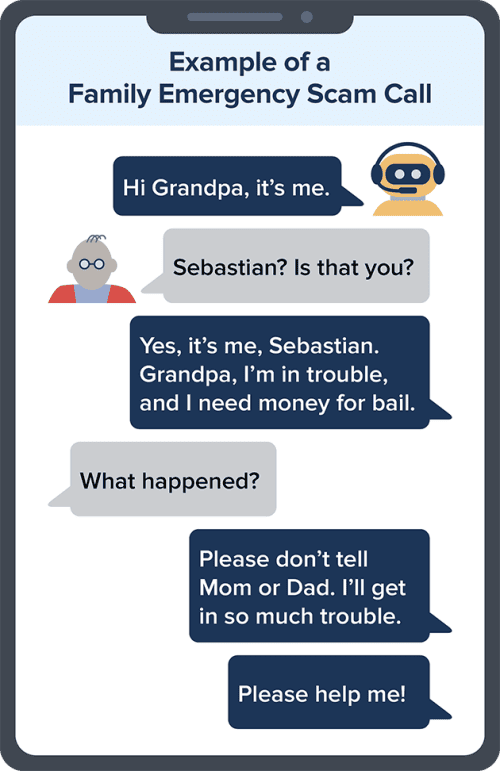

Ejemplo de una estafa de clonación de voz con IA | Fuente: FTC

La clonación de voz con IA hace posible que los estafadores suenen exactamente como alguien que conoces. Pueden recrear la voz de un CEO, de tu gerente o incluso de un miembro de tu familia, y luego llamarte con instrucciones urgentes para enviarte criptomonedas o aprobar una transacción.

Esta técnica fue utilizada en el robo de 25 millones de dólares en Hong Kong mencionado anteriormente. El empleado no fue engañado solo por un video deepfake; los atacantes también clonaron voces en tiempo real para sellar el engaño. Con solo unos segundos de audio, los estafadores pueden recrear la voz de alguien con una precisión sorprendente.

Estas llamadas a menudo ocurren fuera de horario o en situaciones de emergencia. Podrías escuchar algo como: “Hola, soy yo. Nuestra cuenta está congelada. Necesito que envíes

USDT ahora mismo.” Si la voz suena familiar y la solicitud es urgente, es posible que no lo pongas en duda, especialmente si el número parece legítimo.

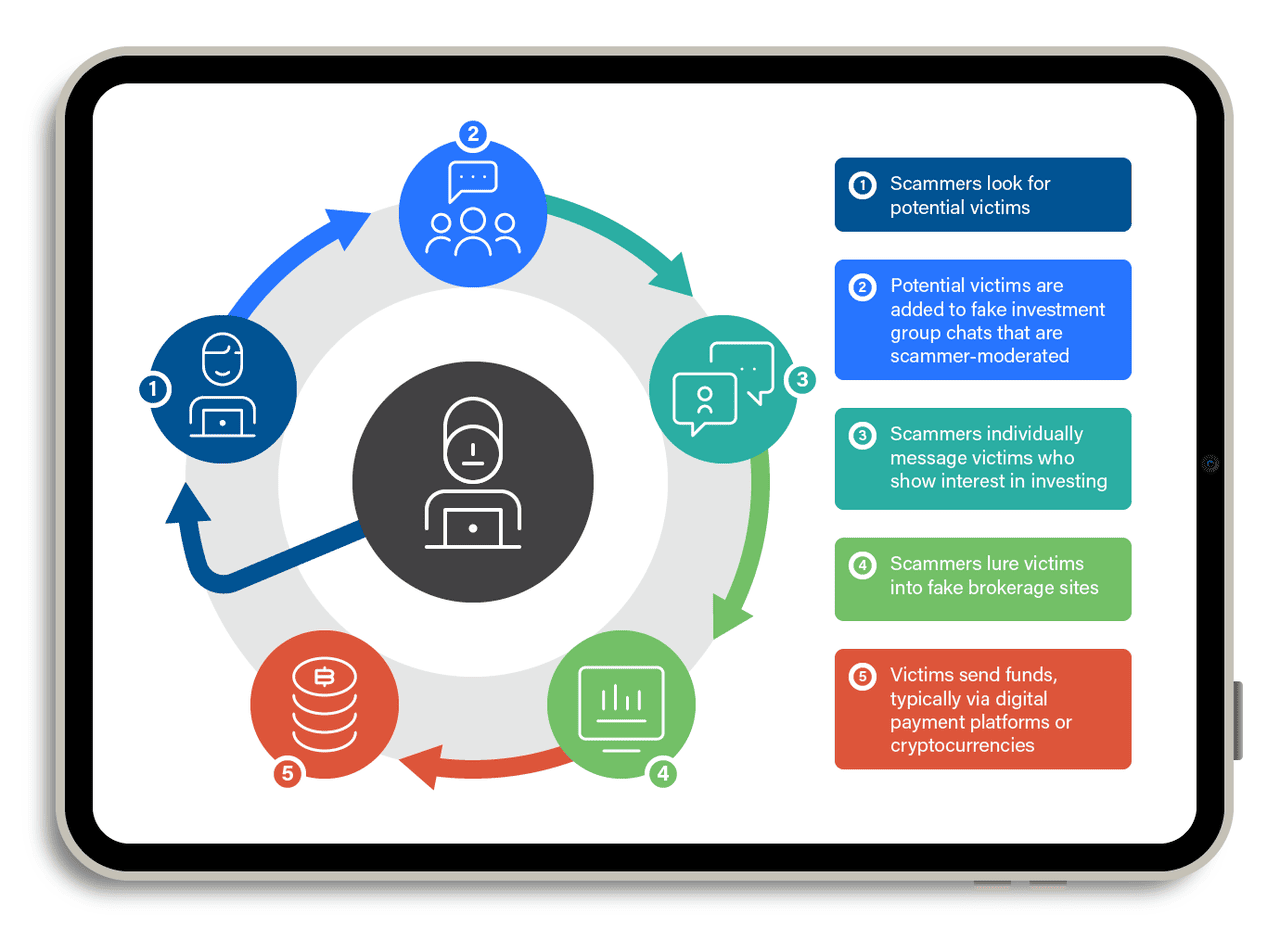

5. Estafa de "matadero de cerdos" con IA

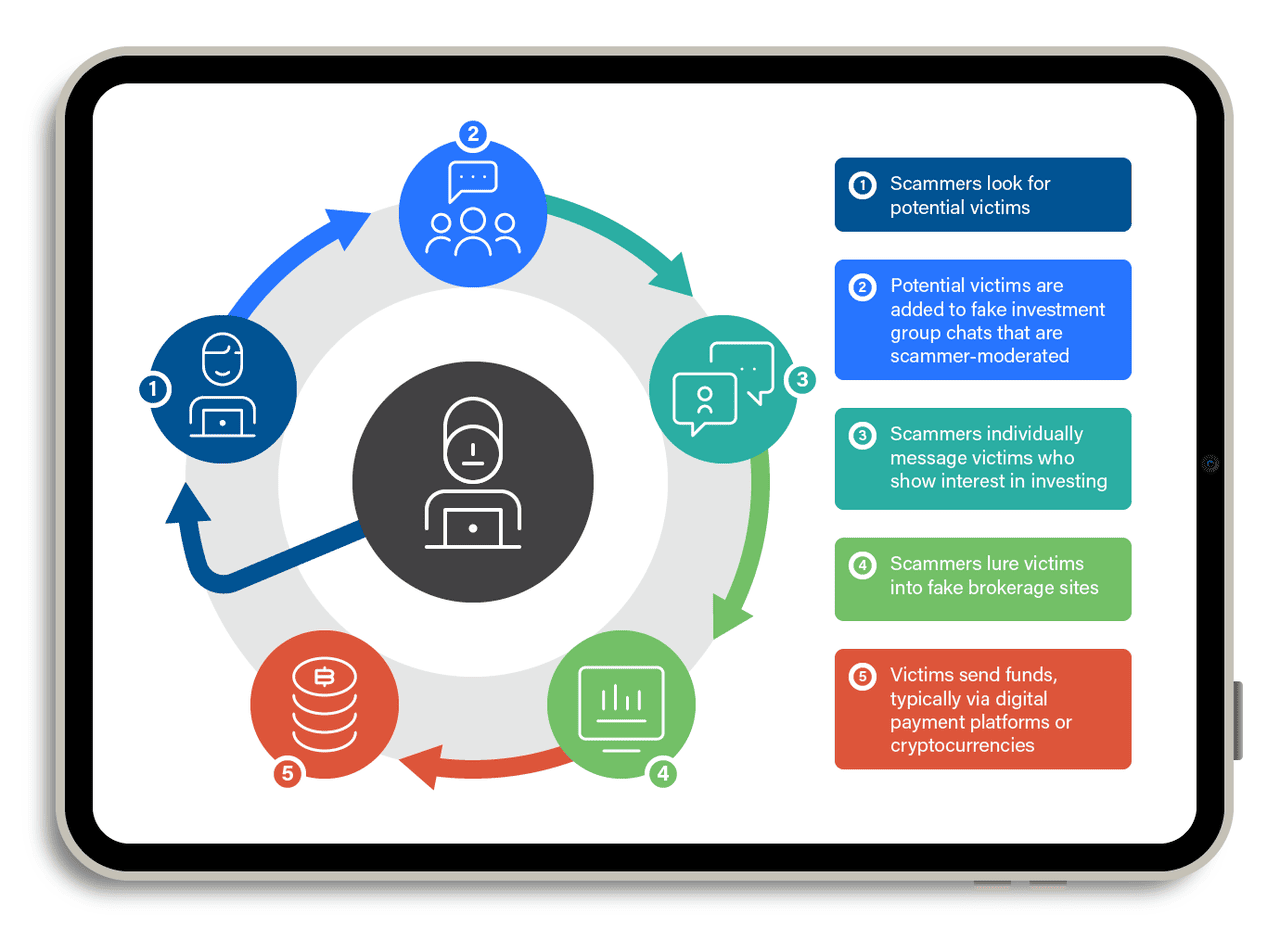

Cómo funciona una estafa de "matadero de cerdos" | Fuente: TrendMicro

Las estafas de "matadero de cerdos" son engaños a largo plazo. Implican construir confianza con el tiempo, tal vez durante semanas o incluso meses. Los estafadores se hacen pasar por un interés romántico o un socio comercial, a menudo utilizando aplicaciones de citas, Telegram o WeChat. Una vez que ganan tu confianza, te convencen de invertir en una plataforma de criptomonedas falsa.

Ahora, están utilizando chatbots de IA para escalar esta estrategia. Estos bots mantienen conversaciones naturales y fluidas. Te siguen regularmente, responden a tus preguntas e incluso ofrecen consejos sobre la vida. Todo está guionizado, pero se siente real.

En 2024, Chainalysis informó que las estafas de "matadero de cerdos" asistidas por IA generaron más de 9,9 mil millones de dólares a nivel mundial. Algunos estafadores incluso usan deepfakes para llamadas de video, mostrando un rostro amigable que parece humano. Las víctimas depositan pequeñas cantidades, ven ganancias falsas y luego invierten más, hasta que el sitio desaparece o los retiros son bloqueados.

Todas estas estafas dependen de una cosa: tu confianza. Al imitar personas reales, plataformas y equipos de soporte, las herramientas de IA hacen más difícil distinguir entre lo que es real y lo que es falso. Pero una vez que entiendas cómo funcionan estas estafas, estarás mucho mejor preparado para detenerlas. Mantente alerta y no dejes que la IA te robe tus criptomonedas.

Cómo defenderte de las estafas con IA

Las estafas con IA están volviéndose más inteligentes, pero tú puedes adelantarte. Sigue estos consejos para proteger tus criptomonedas y tu tranquilidad.

1. Habilita 2FA y usa una clave de hardware si es posible: Activa la

autenticación en dos factores (2FA) para tu cuenta de BingX y aplicaciones de billetera. Utiliza una aplicación como

Google Authenticator o un dispositivo físico como YubiKey. Esto agrega una segunda capa de seguridad, incluso si tu contraseña se ve comprometida.

2. Verifica los enlaces y URLs cuidadosamente: Antes de hacer clic en algo, pasa el cursor sobre los enlaces para verificar la URL. Asegúrate de que coincida con el dominio oficial de BingX. Marca las páginas de inicio de sesión y evita hacer clic en enlaces enviados por correo electrónico, Discord o Telegram.

3. Desconfía de todo lo que suene demasiado bueno: Si alguien promete "ganancias garantizadas" o duplicar los retornos a través de un bot de IA o una herramienta de trading, es una estafa. La IA no garantiza ganancias, y nadie da criptomonedas gratis sin un truco.

4. Nunca compartas frases semilla ni claves privadas: Nadie de BingX o cualquier plataforma legítima te pedirá tus claves privadas. Si alguien lo hace, está intentando robar tus fondos. No ingreses frases semilla en sitios web aleatorios ni se las envíes a alguien que diga que te ayudará.

5. Usa solo el soporte oficial de BingX: Los estafadores a menudo se hacen pasar por agentes de soporte. Siempre accede al soporte de BingX a través del sitio web o la aplicación oficial. No confíes en los mensajes directos no solicitados, incluso si parecen legítimos.

6. Guarda las criptomonedas a largo plazo en una billetera de hardware: Guarda la mayoría de tus criptomonedas en almacenamiento en frío.

Las billeteras de hardware como

Ledger o Trezor mantienen tus claves privadas fuera de línea, protegidas contra ataques remotos, incluso si caes en una estafa de phishing en línea.

7. Mantente informado con los recursos de aprendizaje de BingX: Las estafas evolucionan rápido, y tus conocimientos también deberían hacerlo. Sigue

BingX Academy para obtener consejos de seguridad actualizados, alertas de estafas y guías de seguridad en criptomonedas. La educación es tu mejor defensa.

Conclusión y puntos clave

Las estafas en criptomonedas impulsadas por IA están evolucionando rápidamente. Pero con los hábitos correctos, puedes evitar convertirte en un objetivo.

Mantente alerta ante señales de advertencia como videos deepfake, mensajes generados por IA o plataformas de trading falsas. Protege tus activos con herramientas como 2FA, billeteras de hardware y URLs seguras. Nunca compartas tu frase semilla. Y siempre revisa antes de hacer clic o enviar cualquier cosa.

Lo más importante es seguir aprendiendo. Cuanto más sepas, más seguro estarás. Sigue BingX Academy para obtener las últimas actualizaciones, consejos de seguridad y educación sobre criptomonedas, para que puedas operar con confianza en un mundo que cambia rápidamente.

Lecturas relacionadas

El aumento de los fraudes habilitados por IA de 2022 a 2025 | Fuente: TRM Labs

El aumento de los fraudes habilitados por IA de 2022 a 2025 | Fuente: TRM Labs Los flujos y depósitos de estafas con IA están en aumento | Fuente: Chainalysis

Los flujos y depósitos de estafas con IA están en aumento | Fuente: Chainalysis Cómo se movieron los fondos de una estafa de Deepfake | Fuente: TRM Labs

Cómo se movieron los fondos de una estafa de Deepfake | Fuente: TRM Labs Ejemplo de un sitio web de phishing generado por IA | Fuente: MailGun

Ejemplo de un sitio web de phishing generado por IA | Fuente: MailGun Cómo MetaMax utilizó IA para crear una empresa falsa con empleados falsos | Fuente: TRM Labs

Cómo MetaMax utilizó IA para crear una empresa falsa con empleados falsos | Fuente: TRM Labs Ejemplo de una estafa de clonación de voz con IA | Fuente: FTC

Ejemplo de una estafa de clonación de voz con IA | Fuente: FTC Cómo funciona una estafa de "matadero de cerdos" | Fuente: TrendMicro

Cómo funciona una estafa de "matadero de cerdos" | Fuente: TrendMicro