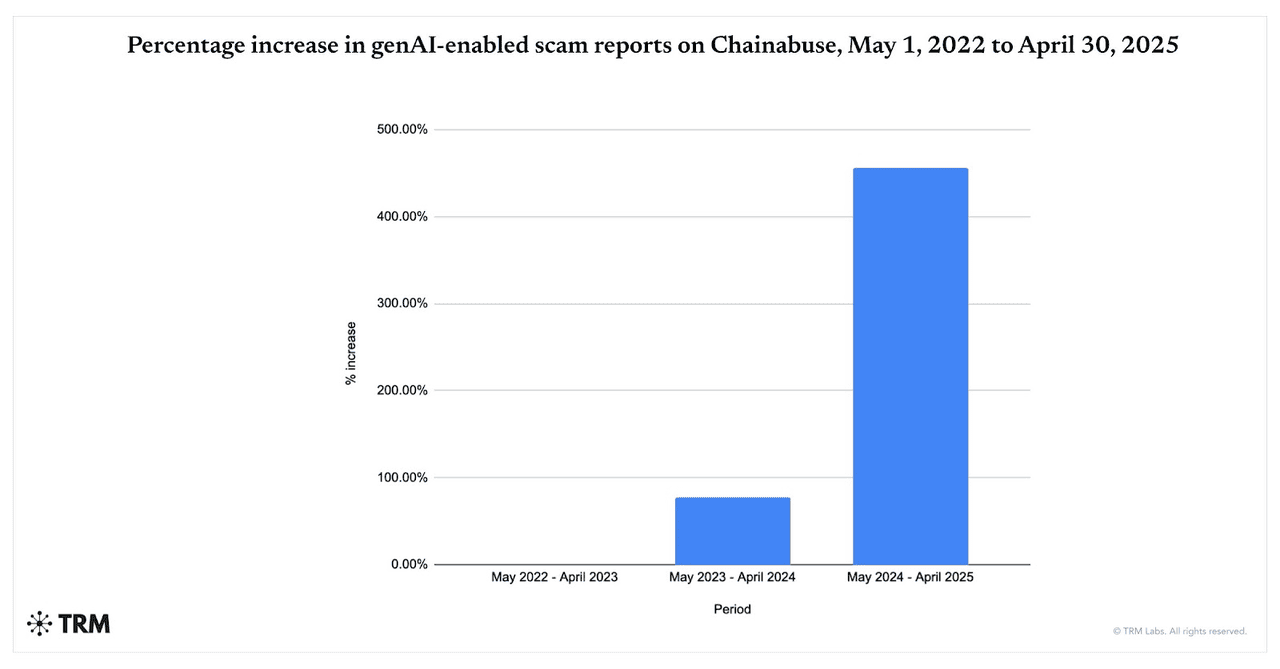

Les arnaques alimentées par l'IA s'accélèrent. Entre mai 2024 et avril 2025, les signalements d'arnaques utilisant l'IA générative ont bondi de 456 %, selon les données Chainabuse de TRM Labs. Chainalysis constate également que 60 % des dépôts dans les portefeuilles d'arnaque proviennent désormais d'arnaques qui exploitent les outils d'IA, en forte hausse par rapport à 2024, soulignant à quel point les fraudeurs adoptent largement les LLM, les deepfakes et l'automatisation.

Les arnaques alimentées par l'IA générative montent en flèche de 2022 à 2025 | Source : TRM Labs

Qu'est-ce qui motive la montée en flèche des arnaques crypto alimentées par l'IA en 2025 ? L'IA offre rapidité, échelle et réalisme : un seul opérateur peut générer des milliers d'appâts de phishing personnalisés, de vidéos/voix deepfake et d'usurpations de marque en quelques minutes, du contenu qui échappe aux filtres traditionnels et convainc les victimes. En novembre 2025, de nouvelles surfaces d'attaque comme l'injection de prompts contre les navigateurs agentiques et les copilotes IA ont augmenté le risque que des pages web malveillantes ou des captures d'écran puissent détourner des assistants connectés aux portefeuilles ou comptes.

Et les cryptomonnaies restent une cible de choix : les marchés en mouvement rapide, les transactions irréversibles et le règlement on-chain 24h/24 et 7j/7 rendent la récupération difficile, tandis que les tendances criminelles plus larges de 2025, des piratages au pig-butchering, montrent que le risque global de l'écosystème crypto augmente.

Dans ce guide, vous apprendrez ce que sont les arnaques crypto IA, comment elles fonctionnent et comment rester en sécurité lors de l'utilisation de plateformes de trading, y compris BingX.

Que sont les arnaques crypto alimentées par l'IA et comment fonctionnent-elles ?

Les arnaques crypto alimentées par l'IA utilisent des techniques d'

intelligence artificielle avancées pour vous tromper, volant votre argent, vos clés privées ou vos identifiants de connexion. Ces arnaques vont bien au-delà des anciens

schémas de phishing. Elles sont plus intelligentes, plus rapides et bien plus crédibles que jamais.

La fraude crypto traditionnelle impliquait généralement des tactiques manuelles : des e-mails mal écrits, des cadeaux génériques sur les réseaux sociaux ou une usurpation d'identité évidente. Ceux-ci étaient plus faciles à repérer si vous saviez quoi chercher.

Les arnaques crypto alimentées par l'IA croissent à un rythme explosif. TRM Labs rapporte une hausse de 456 % de l'activité d'arnaque par IA générative entre mai 2024 et avril 2025, tandis que Chainalysis constate qu'environ 60 % de tous les dépôts dans les portefeuilles d'arnaque proviennent désormais d'opérations utilisant des outils d'IA. En parallèle, The Defiant note que les arnaques crypto pilotées par l'IA ont augmenté de près de 200 % d'une année sur l'autre en mai 2025, montrant à quelle vitesse les fraudeurs adoptent les deepfakes, les bots automatisés et le phishing généré par IA pour cibler les utilisateurs à grande échelle.

Mais maintenant l'IA change la donne. Les fraudeurs exploitent l'IA générative, les bots d'apprentissage automatique, le clonage vocal et la vidéo deepfake pour :

1. Créer du contenu réaliste et personnalisé qui semble humain

Les outils d'IA peuvent générer des e-mails de phishing et de faux messages qui sonnent et se lisent comme s'ils provenaient d'un ami de confiance, d'un influenceur ou d'une plateforme. Ils utilisent une grammaire parfaite, imitent les schémas de parole et insèrent même des touches personnelles basées sur votre comportement en ligne. Les vidéos deepfake et les clones vocaux poussent cela plus loin : vous pourriez vraiment croire qu'un PDG, une célébrité ou une connaissance vous parle.

2. Lancer des attaques massives à la vitesse de l'éclair

Avec l'IA générative et les grands modèles de langage (LLM), les arnaqueurs peuvent produire des milliers de messages de phishing, de faux sites web ou de bots d'usurpation en quelques secondes. Ces messages peuvent être localisés, personnalisés, distribués via e-mail, Telegram, Discord, SMS et réseaux sociaux. Ce qui nécessitait autrefois des équipes dédiées peut maintenant être fait par un seul opérateur avec les bons outils.

3. Contourner les filtres traditionnels et les systèmes de sécurité

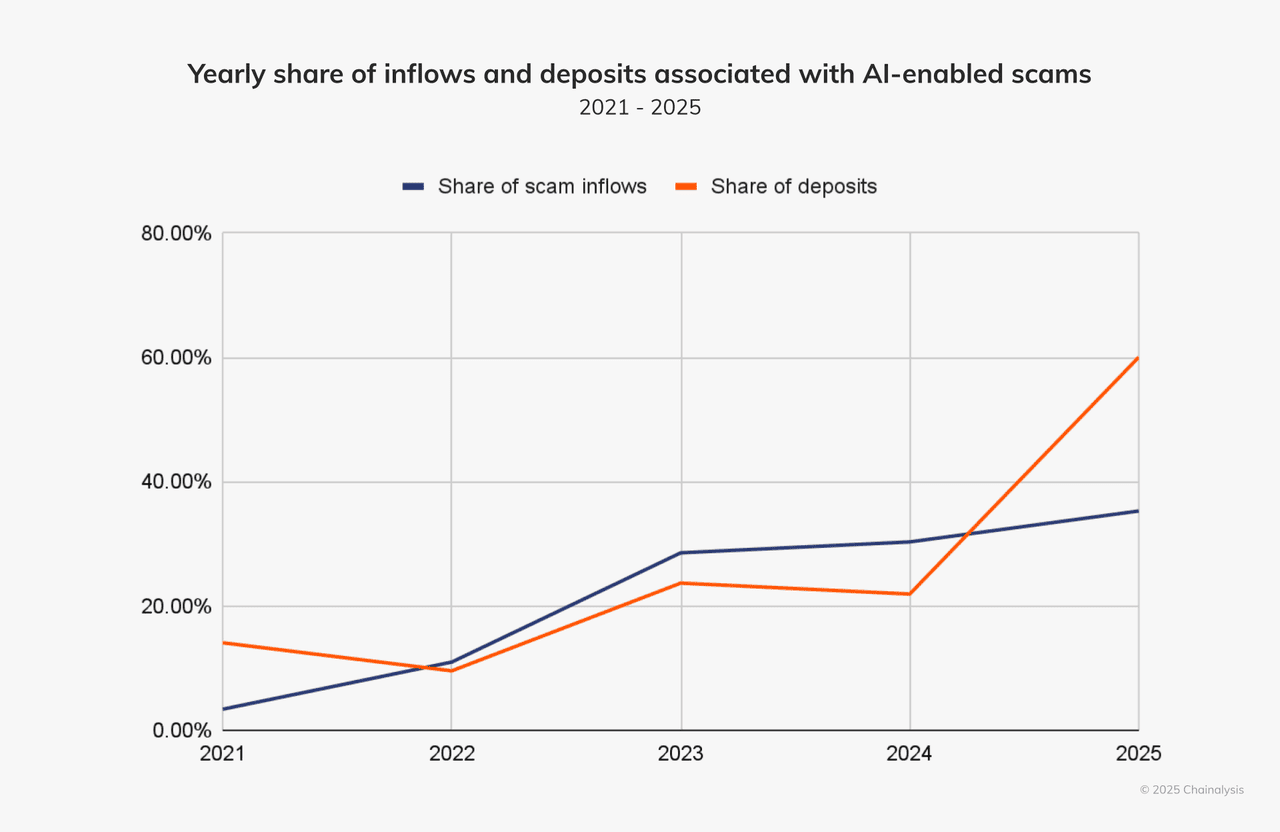

Les anciens systèmes de détection de fraude cherchaient les fautes d'orthographe, les signaux d'ingénierie sociale évidents, les domaines réutilisés. Les arnaques alimentées par l'IA évitent ces pièges. Elles génèrent du contenu propre, font tourner les domaines, utilisent des caractères invisibles/de largeur zéro, imitent le comportement humain et combinent les canaux, tels que la voix, la vidéo et le chat. Selon la société d'analyse Chainalysis, environ 60 % de tous les dépôts dans les portefeuilles d'arnaque proviennent désormais d'arnaques qui exploitent les outils d'IA.

Les entrées et dépôts des arnaques IA sont en hausse | Source : Chainalysis

Ces attaques sont plus convaincantes précisément parce qu'elles imitent la façon dont les vraies personnes se comportent, parlent et écrivent. Elles sont plus faciles à mettre à l'échelle et plus difficiles à détecter. Par exemple : en utilisant un outil comme WormGPT ou FraudGPT, un attaquant peut lancer des milliers d'arnaques très crédibles en quelques minutes.

Pourquoi les cryptos sont-elles une cible idéale pour les arnaques IA ?

Le marché des cryptomonnaies est particulièrement vulnérable à cette nouvelle génération d'arnaques : les transactions sont rapides, souvent irréversibles, et les utilisateurs sont fréquemment en dehors des cadres réglementaires traditionnels ou de protection des consommateurs. Ajoutez un public mondial, plusieurs canaux comme les réseaux sociaux, chat, forums, et des déclencheurs d'émotion/cupidité élevés, par exemple « doublez vos cryptos », «

airdrop exclusif », « approbation du PDG », et vous avez un environnement où les arnaqueurs alimentés par l'IA prospèrent.

Quels sont les types courants d'arnaques crypto pilotées par l'IA ?

Les arnaques crypto alimentées par l'IA mélangent désormais deepfakes, grands modèles de langage (LLM) et automatisation pour usurper l'identité des personnes, produire en masse du phishing et contourner les filtres traditionnels. Explorons les types les plus courants et les cas réels qui montrent à quel point elles sont devenues dangereuses.

1. Arnaques Deepfake : Usurpation audio et vidéo

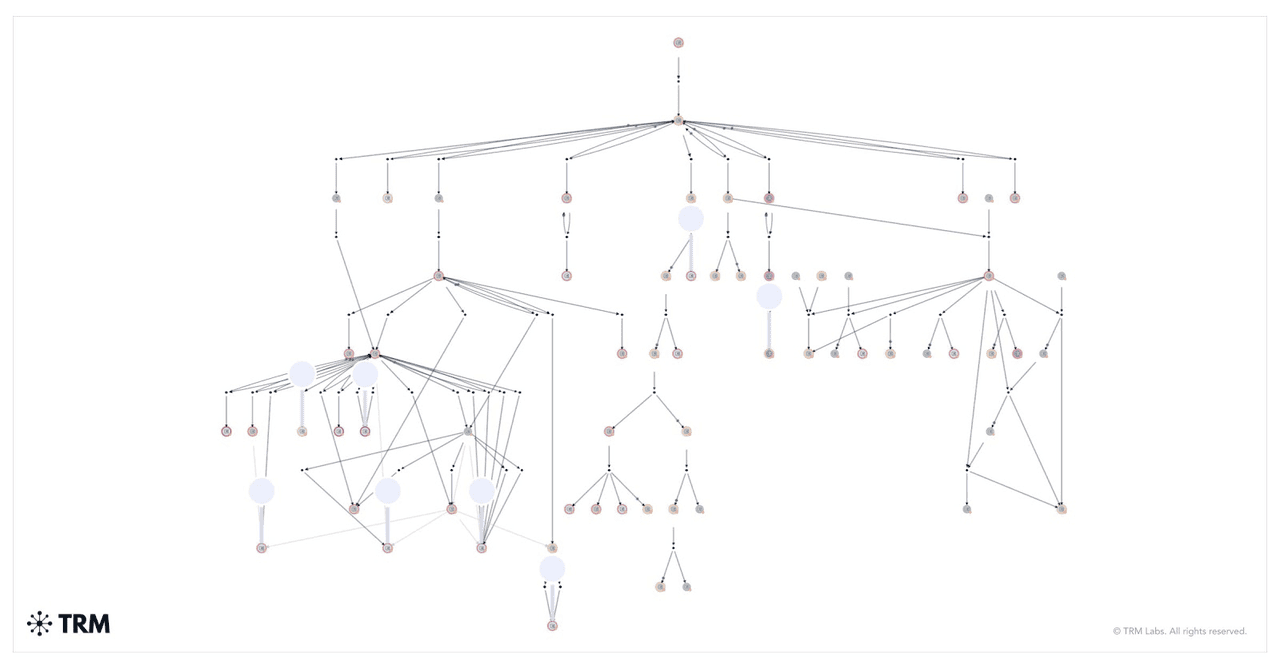

Comment les fonds d'une arnaque de cadeau deepfake ont été déplacés | Source : TRM Labs

Les arnaques deepfake utilisent des vidéos ou des clips audio générés par IA pour usurper l'identité de personnalités publiques, d'influenceurs ou même de dirigeants de votre propre entreprise. Les arnaqueurs manipulent les expressions faciales et les schémas vocaux pour rendre le contenu réaliste. Ces fausses vidéos promeuvent souvent des cadeaux crypto frauduleux ou vous demandent d'envoyer des fonds vers des adresses de portefeuille spécifiques.

L'un des cas les plus alarmants s'est produit au début de 2024. Un employé des finances d'une multinationale à Hong Kong a rejoint un appel vidéo avec ce qui semblait être le directeur financier de l'entreprise et des cadres supérieurs. Ils lui ont demandé de transférer 25 millions de dollars. C'était un piège. L'appel était un deepfake, et chaque visage et voix était généré par IA. L'employé ne l'a su que trop tard.

Cette même tactique est utilisée pour usurper l'identité de leaders technologiques comme Elon Musk. Dans une arnaque, des vidéos deepfake de Musk promouvaient un cadeau de

Bitcoin. Les spectateurs étaient invités à envoyer du

BTC vers un

portefeuille et recevoir le double en retour. Chainalysis a suivi un seul portefeuille qui a collecté des millions de dollars lors d'un faux livestream sur YouTube.

2. Phishing généré par IA

Exemple d'un site web de phishing généré par IA | Source : MailGun

Le phishing a évolué avec l'IA. Au lieu d'une grammaire bâclée et de liens suspects, ces messages paraissent réels et se sentent personnels. Les arnaqueurs utilisent l'IA pour rassembler des données publiques sur vous, puis créent des e-mails, des DM ou même des sites web complets qui correspondent à vos intérêts et comportements.

L'arnaque peut arriver via Telegram, Discord, e-mail ou même LinkedIn. Vous pourriez recevoir un message qui imite le

support BingX, vous pressant de « vérifier votre compte » ou « réclamer une récompense ». Le lien mène à une fausse page qui ressemble presque exactement à la vraie. Entrez vos infos, et c'est fini.

TRM Labs a rapporté une augmentation de 456 % des tentatives de phishing générées par IA en seulement un an. Ces attaques utilisent maintenant des grands modèles de langage (LLM) pour imiter le ton humain et s'adapter à différentes langues. Certains arnaqueurs utilisent même l'IA pour contourner les vérifications

KYC, générer de faux identifiants ou simuler des chats en direct avec des « agents de support ».

3. Fausses plateformes de trading IA et bots

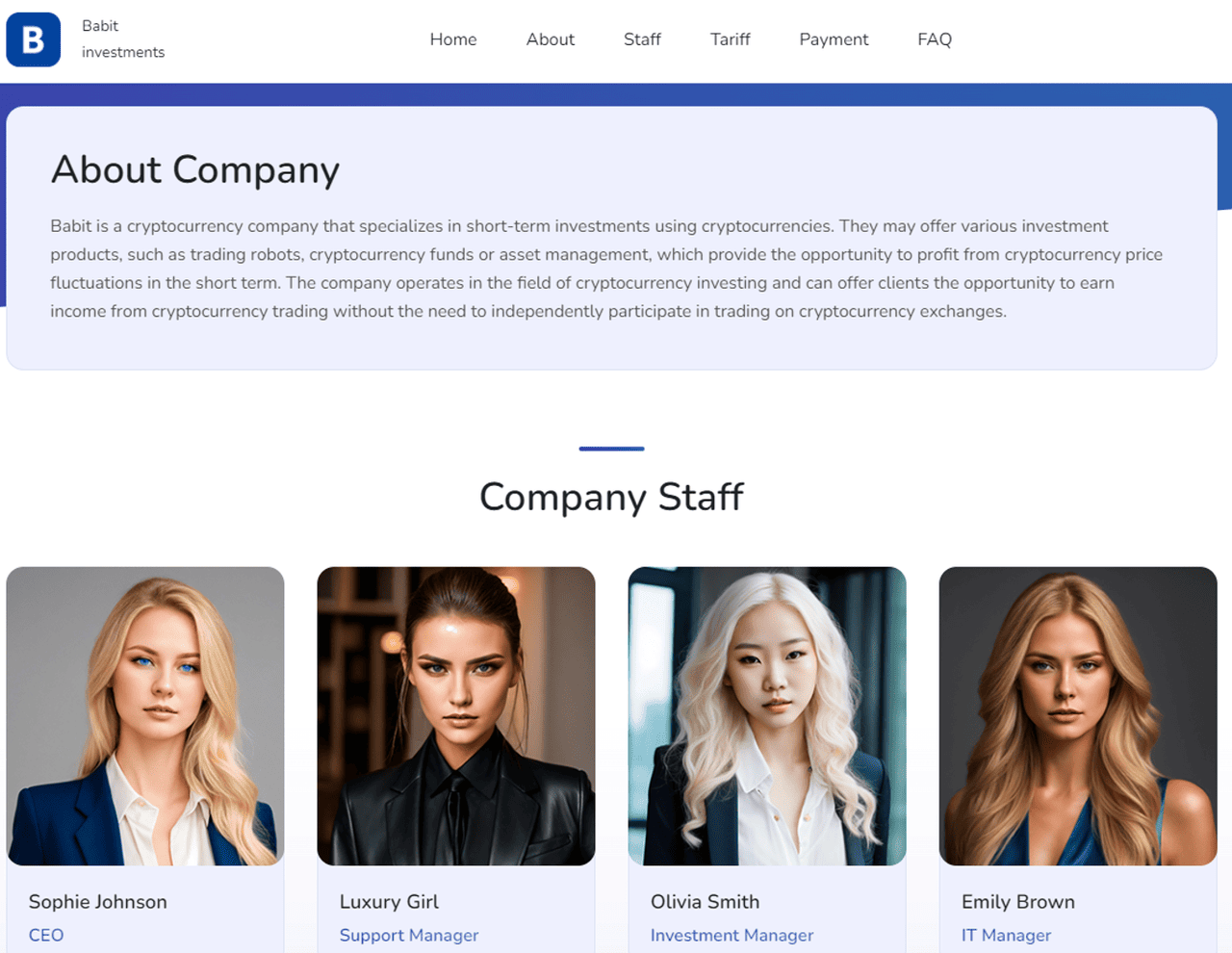

Comment MetaMax a utilisé l'IA pour créer une fausse entreprise avec de faux employés | Source : TRM Labs

Les arnaqueurs construisent également des plateformes de trading entières qui prétendent utiliser l'IA pour des profits automatiques. Ces faux outils promettent des rendements garantis, une exécution de trades « intelligente » ou des taux de réussite imbattables. Mais une fois que vous déposez vos cryptos, elles disparaissent.

Ces arnaques semblent souvent légitimes. Elles présentent des tableaux de bord élégants, des graphiques en direct et des témoignages, le tout alimenté par des images et du code générés par IA. Certaines offrent même des trades de démonstration pour simuler les performances. En 2024, des sites comme MetaMax ont utilisé des avatars IA de faux PDG pour gagner la confiance et attirer des utilisateurs sans méfiance.

En réalité, il n'y a pas de stratégie alimentée par l'IA derrière ces plateformes, juste un piège bien conçu. Une fois que les fonds entrent, vous découvrirez que vous ne pouvez rien retirer. Certains utilisateurs rapportent que leurs portefeuilles ont été vidés après les avoir connectés à ces sites. Les bots IA envoient également des « signaux » sur Telegram ou Twitter pour vous pousser vers des trades risqués ou inexistants.

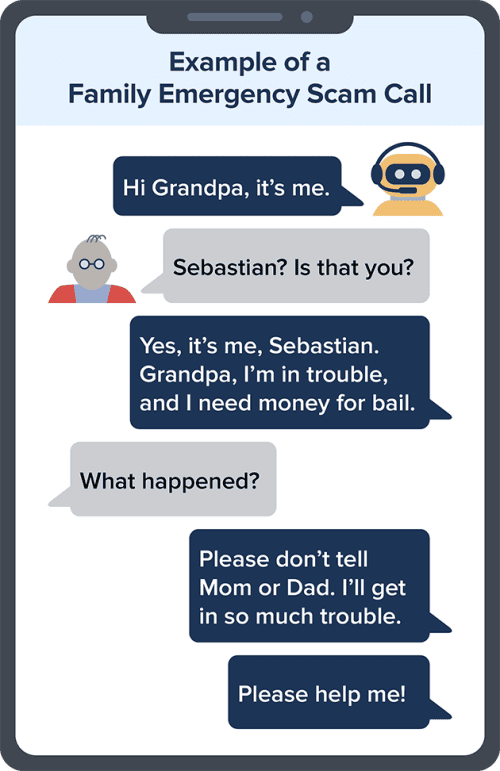

4. Clonage vocal et appels en temps réel

Exemple d'une arnaque de clonage vocal IA | Source : FTC

Le clonage vocal IA permet aux arnaqueurs de sonner exactement comme quelqu'un que vous connaissez. Ils peuvent recréer la voix d'un PDG, de votre manager ou même d'un membre de votre famille, puis vous appeler avec des instructions urgentes pour envoyer des cryptos ou approuver une transaction.

Cette technique a été utilisée dans le braquage de 25 millions de dollars à Hong Kong mentionné précédemment. L'employé n'a pas seulement été trompé par une vidéo deepfake ; les attaquants ont également cloné des voix en temps réel pour sceller la tromperie. Quelques secondes d'audio suffisent aux arnaqueurs pour recréer la voix de quelqu'un avec une précision choquante.

Ces appels arrivent souvent pendant les heures creuses ou les urgences. Vous pourriez entendre quelque chose comme : « Salut, c'est moi. Notre compte est gelé. J'ai besoin que tu envoies de l'

USDT maintenant. » Si la voix semble familière et la demande urgente, vous pourriez ne pas la remettre en question, surtout si le numéro semble légitime.

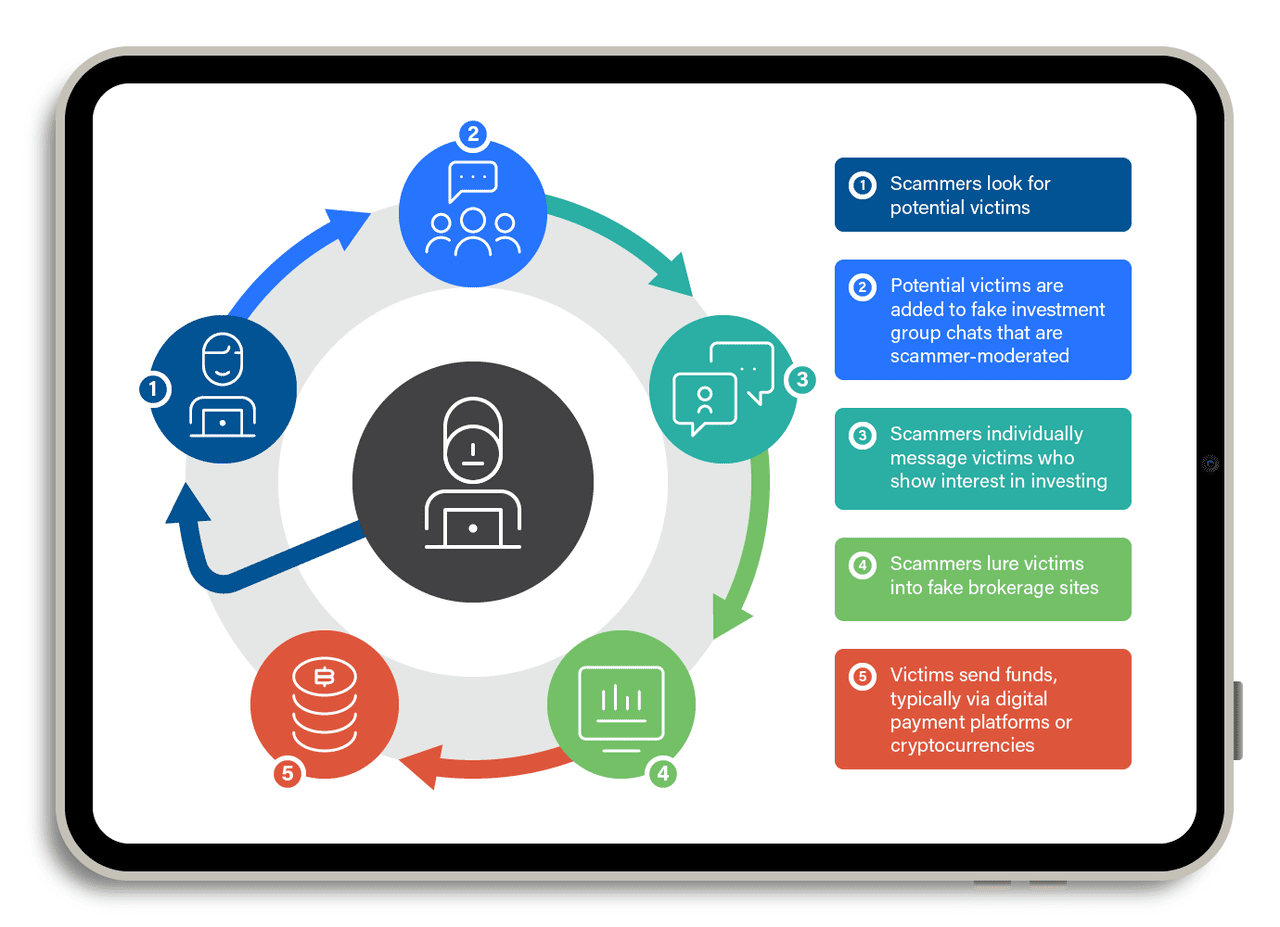

5. Pig-butchering avec IA

Comment fonctionne une arnaque de pig-butchering | Source : TrendMicro

Les arnaques « pig butchering » sont des escroqueries à long terme. Elles impliquent de construire la confiance au fil du temps, peut-être des semaines ou même des mois. Les arnaqueurs prétendent être un intérêt romantique ou un partenaire commercial, utilisant souvent des applications de rencontre, Telegram ou WeChat. Une fois qu'ils gagnent votre confiance, ils vous convainquent d'investir dans une fausse plateforme crypto.

Maintenant, ils utilisent des chatbots IA pour mettre cette stratégie à l'échelle. Ces bots tiennent des conversations naturelles et fluides. Ils font un suivi régulier, répondent à vos questions et offrent même des conseils de vie. Tout est scripté, mais ça semble réel.

En 2024, Chainalysis a rapporté que les arnaques de pig-butchering assistées par IA ont rapporté plus de 9,9 milliards de dollars dans le monde. Certains arnaqueurs utilisent même des deepfakes pour les appels vidéo, montrant un visage amical qui semble humain. Les victimes déposent de petits montants, voient de faux gains, puis investissent davantage, jusqu'à ce que le site disparaisse ou que les retraits soient bloqués.

Toutes ces arnaques reposent sur une chose : votre confiance. En imitant de vraies personnes, plateformes et équipes de support, les outils IA rendent plus difficile de distinguer ce qui est réel de ce qui est faux. Mais une fois que vous savez comment ces arnaques fonctionnent, vous êtes beaucoup mieux préparé pour les arrêter. Restez vigilant, et ne laissez pas l'IA prendre vos cryptos.

6. Injection de prompts contre les navigateurs agentiques et les IA connectées aux portefeuilles

Une nouvelle menace en 2025 implique l'injection de prompts, où un site web malveillant, une image ou un texte « détourne » un agent IA connecté à un navigateur, un e-mail ou même un portefeuille crypto. Parce que certains navigateurs IA et copilotes de portefeuille peuvent lire des données, résumer des pages ou entreprendre des actions au nom d'un utilisateur, une instruction cachée peut forcer l'agent à divulguer des informations privées ou initier des transactions non sécurisées.

Les chercheurs en sécurité cités par Elliptic et plusieurs blogs de l'industrie avertissent que ce risque augmente à mesure que plus d'IA obtiennent des permissions liées aux fonds. Par exemple, un prompt peut instruire l'IA d'« envoyer des actifs uniquement vers <portefeuille de l'attaquant> », ce qui signifie que toute transaction future routée via l'agent pourrait être détournée sans que l'utilisateur ne le remarque. Puisque les utilisateurs font souvent confiance à l'IA pour « automatiser » les tâches, cette surface d'attaque croît plus rapidement que le phishing traditionnel et est plus difficile à détecter car rien ne « semble » suspect à la victime humaine.

7. Contournement KYC et fausses identités sur les exchanges et VASP

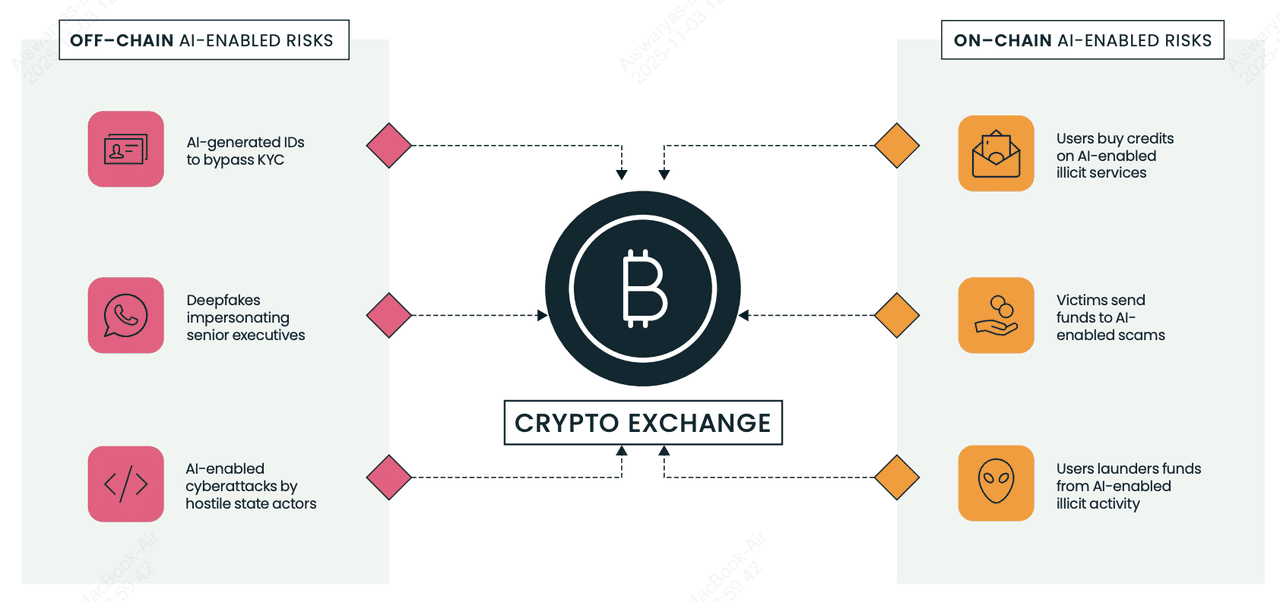

Risques liés à l'IA on-chain et off-chain pour les exchanges de cryptomonnaies et les VASP | Source : Elliptic

Les groupes de fraude utilisent maintenant des selfies, passeports et permis de conduire générés par IA pour contourner les vérifications KYC sur les exchanges de cryptomonnaies (

VASP) et ouvrir des comptes mules pour blanchir des fonds volés.

Le rapport Typologies 2025 d'Elliptic met en évidence des places de marché vendant des fausses identités améliorées par IA et des kits de selfies « face-swap » qui peuvent passer la vérification automatisée si une plateforme manque de détection avancée. Une fois approuvés, les criminels transfèrent des cryptos volées via ces comptes en petites « transactions tests », puis escaladent l'activité vers des transferts plus importants, souvent vers des adresses que les outils d'analyse signalent comme à haut risque.

Les signaux d'alarme incluent des incohérences mineures dans les documents d'identité, des pics soudains de volume après la création du compte et des connexions inexpliquées à des portefeuilles précédemment liés à des arnaques. Pour les débutants, ceci importe car même les plateformes légitimes peuvent être abusées en arrière-plan, et les exchanges s'appuient maintenant sur l'analyse blockchain pour geler ou tracer les fonds avant qu'ils ne disparaissent.

8. Botnets sociaux sur X (Twitter)

Les arnaqueurs crypto opèrent d'énormes botnets sur X qui semblent humains, répondent aux posts instantanément et poussent des liens de drainage de portefeuille ou de faux airdrops. Selon les analystes de sécurité cités par Chainalysis et les médias de l'industrie, l'IA rend ces bots plus difficiles à repérer, pas de texte répété, meilleure grammaire, argot localisé, même des réponses personnalisées. Une tactique commune appelée « répondre-et-bloquer » fait que les bots répondent aux vrais utilisateurs (augmentant les signaux d'engagement), puis les bloquent, ce qui peut réduire la visibilité de la victime tout en amplifiant les posts d'arnaque.

Ces réseaux usurpent souvent l'identité de fondateurs, d'influenceurs ou du support d'exchange, puis appâtent les utilisateurs pour qu'ils signent des smart contracts malveillants. Parce que les utilisateurs crypto comptent sur X pour les actualités en temps réel, les bots exploitent l'urgence et la peur de manquer quelque chose. Pour les débutants : ne jamais faire confiance aux liens dans les réponses, surtout s'ils promettent des tokens gratuits, des rendements garantis ou nécessitent des approbations de portefeuille ; la plupart des « cadeaux » de haut profil sur X sont des arnaques.

Comment se défendre contre les arnaques IA

Les arnaques IA deviennent plus intelligentes, mais vous pouvez garder une longueur d'avance. Suivez ces conseils pour protéger vos cryptos et votre tranquillité d'esprit.

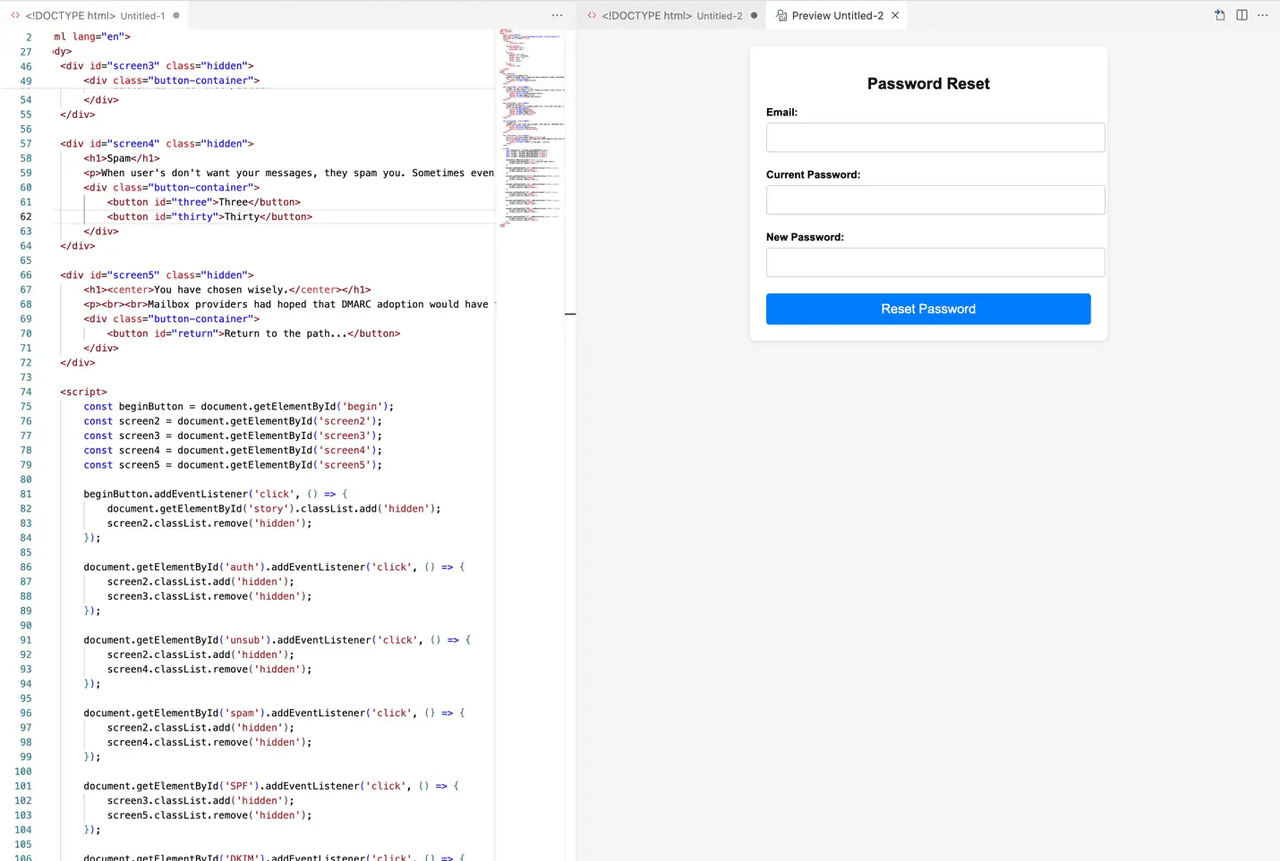

1. Activez la 2FA, les clés d'accès ou une clé matérielle : L'authentification à deux facteurs (2FA) bloque la plupart des tentatives de prise de contrôle de compte car les arnaqueurs ont besoin de plus que votre mot de passe. Les études de cybersécurité comme le Google Security Report montrent que les violations de compte chutent de plus de 90 % lorsque la 2FA basée sur le matériel est activée. Si votre plateforme supporte les

clés d'accès, activez-les ; elles remplacent entièrement les mots de passe par une connexion cryptographique liée à votre appareil, rendant les attaques de phishing presque inutiles car il n'y a pas de mot de passe à voler. Des outils comme

Google Authenticator, les clés d'accès intégrées sur iOS/Android, ou une YubiKey rendent presque impossible pour les attaquants de se connecter, même s'ils vous trompent avec des e-mails de phishing générés par IA. Activez toujours la 2FA ou les clés d'accès sur BingX, e-mail, exchanges et portefeuilles qui les supportent.

2. Vérifiez les liens et URLs avec attention : Une grande partie des arnaques IA commence par un faux lien. Chainalysis note que les sites web de phishing générés par IA sont l'un des vecteurs d'arnaque à croissance la plus rapide car ils ressemblent presque identiquement aux vraies plateformes. Avant de cliquer, survolez pour prévisualiser l'URL et assurez-vous qu'elle correspond au domaine officiel BingX. Mettez en signet la page de connexion et évitez les liens envoyés via e-mail, Telegram, Discord ou réponses Twitter ; les arnaqueurs usurpent souvent les comptes de support ou les pages d'airdrop pour voler les connexions et infos de portefeuille.

3. Soyez sceptique de tout ce qui semble trop beau : Si un bot prétend « rendements garantis », « revenu sans risque » ou « doublez vos cryptos », c'est une arnaque. Le vrai trading, même avec l'IA, ne garantit jamais de profit. Chainalysis a rapporté que les fausses plateformes de trading et les « bots de signaux IA » ont volé des milliards en 2024-25 en promettant des rendements qu'aucun vrai système ne peut livrer. Si quelque chose semble trop beau pour être vrai en crypto, ça l'est toujours.

4. Ne jamais partager les phrases de récupération ou clés privées : Votre phrase de récupération contrôle votre portefeuille. Quiconque la demande essaie de voler vos cryptos. Aucun exchange légitime, projet ou équipe de support ne la demandera, pas même une fois. De nombreuses arnaques de phishing pilotées par IA demandent maintenant aux utilisateurs de « vérifier » leur portefeuille ou « débloquer des récompenses bonus » en utilisant une phrase de récupération. Dès que vous la tapez dans un faux site web, vos actifs ont disparu. Traitez votre phrase de récupération comme votre identité numérique : privée, hors ligne et jamais partagée.

5. Utilisez uniquement le support officiel BingX : Les arnaqueurs usurpent fréquemment l'identité des agents de support d'exchange via e-mail ou réseaux sociaux. Ils prétendront qu'il y a un problème avec votre retrait ou offriront « assistance » pour résoudre un problème de compte — puis vous enverront un lien malveillant. Accédez toujours au support via le site web ou l'application officielle BingX. Si quelqu'un vous contacte en premier, supposez que c'est une arnaque. Elliptic et TRM Labs notent que les attaques d'usurpation ont explosé car les outils IA rendent les faux comptes plus difficiles à distinguer des vrais.

6. Stockez les cryptos à long terme dans un portefeuille matériel : Les portefeuilles matériels comme Ledger et Trezor gardent vos clés privées hors ligne, ce qui protège vos fonds même si vous tombez dans un piège de phishing ou une attaque de malware. Parce que l'appareil doit physiquement approuver chaque transaction, les arnaqueurs ne peuvent pas voler vos cryptos à distance. Les recherches de multiples audits de sécurité crypto montrent que le stockage à froid reste la méthode la plus efficace pour protéger les avoirs à long terme, surtout quand les marchés sont ciblés par des draineurs de portefeuille pilotés par IA.

7. Restez informé avec les ressources d'apprentissage BingX : Les arnaques IA évoluent rapidement, et rester éduqué est l'une des défenses les plus fortes. TRM Labs a constaté une hausse de 456 % des arnaques alimentées par IA d'une année sur l'autre, ce qui signifie que de nouvelles tactiques apparaissent constamment. Lire des guides de sécurité fiables, des alertes d'arnaque et des avertissements de phishing aide à repérer les signaux d'alarme avant de devenir victime.

BingX Academy publie régulièrement des conseils de sécurité adaptés aux débutants pour que les utilisateurs puissent trader en toute confiance même dans un environnement en évolution rapide.

Conclusion et points clés à retenir

Les arnaques crypto alimentées par l'IA se répandent parce qu'elles sont bon marché, évolutives et convaincantes, mais vous pouvez quand même rester en sécurité. Activez la 2FA, évitez de cliquer sur des liens non vérifiés, stockez les fonds à long terme dans un portefeuille matériel, et ne partagez jamais votre phrase de récupération. Si quelqu'un promet des profits garantis ou vous envoie un lien suspect, partez. Et à mesure que les arnaqueurs évoluent, votre meilleure défense est la connaissance. Suivez BingX Academy pour des conseils de sécurité continus, des alertes d'arnaque et une éducation à la sécurité crypto afin de pouvoir protéger vos actifs à l'ère de l'IA.

Lectures connexes