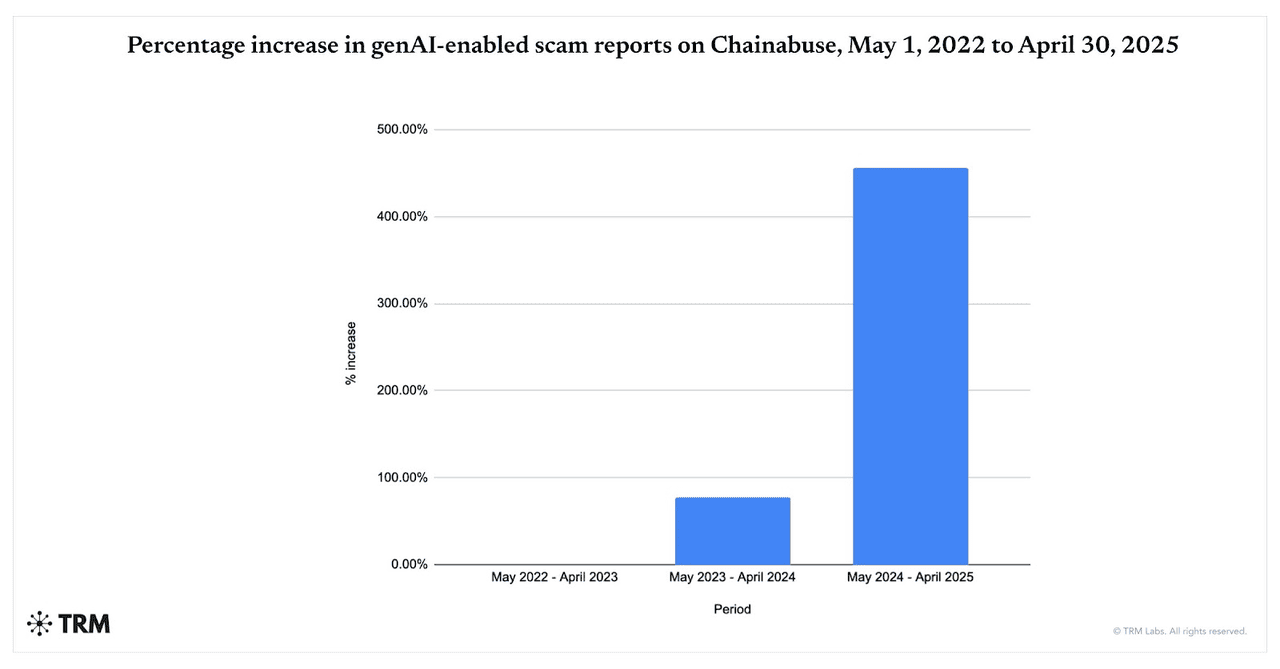

Мошенничества с применением ИИ набирают обороты. В период с мая 2024 года по апрель 2025 года количество сообщений о мошенничествах с использованием генеративного ИИ выросло на 456% по данным TRM Labs' Chainabuse. Chainalysis также обнаруживает, что 60% депозитов в кошельки мошенников теперь поступают к мошенникам, использующим инструменты ИИ, что резко возросло по сравнению с 2024 годом, подчеркивая, насколько широко злоумышленники принимают LLM, дипфейки и автоматизацию.

Резкий рост мошенничеств с использованием генеративного ИИ с 2022 по 2025 годы | Источник: TRM Labs

Что движет резким ростом криптомошенничеств с применением ИИ в 2025 году? ИИ обеспечивает скорость, масштаб и реализм: один оператор может создать тысячи персонализированных фишинговых приманок, дипфейк-видео/голосов и подделок брендов за минуты, контент, который обходит устаревшие фильтры и убеждает жертв. По состоянию на ноябрь 2025 года новые поверхности атак, такие как инъекция промптов против агентских браузеров и ИИ-помощников, повысили риск того, что вредоносные веб-страницы или скриншоты могут захватить помощников, подключенных к кошелькам или аккаунтам.

И криптовалюты остаются основной целью: быстро движущиеся рынки, необратимые транзакции и круглосуточное блокчейн-урегулирование затрудняют восстановление, в то время как более широкие тенденции преступности 2025 года от взломов до "разделки свиней" показывают, что общий риск криптоэкосистемы растет.

В этом руководстве вы узнаете, что такое криптомошенничества с ИИ, как они работают, и как обезопасить себя при использовании торговых платформ, включая BingX.

Что такое криптомошенничества с использованием ИИ и как они работают?

Криптомошенничества с использованием ИИ применяют передовые методы

искусственного интеллекта, чтобы обманывать вас, воруя ваши деньги, приватные ключи или учетные данные для входа. Эти мошенничества намного превосходят старомодные

фишинговые схемы. Они умнее, быстрее и гораздо более убедительны, чем когда-либо прежде.

Традиционное криптомошенничество обычно включало ручные тактики: плохо написанные электронные письма, общие розыгрыши в социальных сетях или очевидную имитацию. Их было легче обнаружить, если знать, на что обращать внимание.

Криптомошенничества с использованием ИИ растут с взрывной скоростью. TRM Labs сообщает о росте активности мошенничеств с генеративным ИИ на 456% в период с мая 2024 года по апрель 2025 года, в то время как Chainalysis обнаруживает, что около 60% всех депозитов в кошельки мошенников теперь поступают от операций с использованием инструментов ИИ. Параллельно The Defiant отмечает, что криптомошенничества с использованием ИИ выросли почти на 200% в годовом исчислении по состоянию на май 2025 года, показывая, насколько быстро мошенники принимают дипфейки, автоматических ботов и фишинг, созданный ИИ, для массового таргетирования пользователей.

Но теперь ИИ меняет правила игры. Мошенники используют генеративный ИИ, ботов машинного обучения, клонирование голоса и дипфейк-видео для:

1. Создания реалистичного и персонализированного контента, который кажется человечным

Инструменты ИИ могут генерировать фишинговые письма и поддельные сообщения, которые звучат и читаются так, как будто они пришли от доверенного друга, влиятельного лица или платформы. Они используют безупречную грамматику, имитируют речевые паттерны и даже вставляют личные штрихи на основе вашего онлайн-поведения. Дипфейк-видео и клоны голоса идут дальше: вы можете искренне поверить, что с вами говорит генеральный директор, знаменитость или знакомый.

2. Запуска массовых атак с молниеносной скоростью

С генеративным ИИ и большими языковыми моделями (LLM) мошенники могут производить тысячи фишинговых сообщений, поддельных веб-сайтов или ботов-имитаторов за секунды. Эти сообщения могут быть локализованы, персонализированы, распространены через электронную почту, Telegram, Discord, SMS и социальные сети. То, что раньше требовало специальных команд, теперь может быть сделано одним оператором с правильными инструментами.

3. Обхода традиционных фильтров и систем безопасности

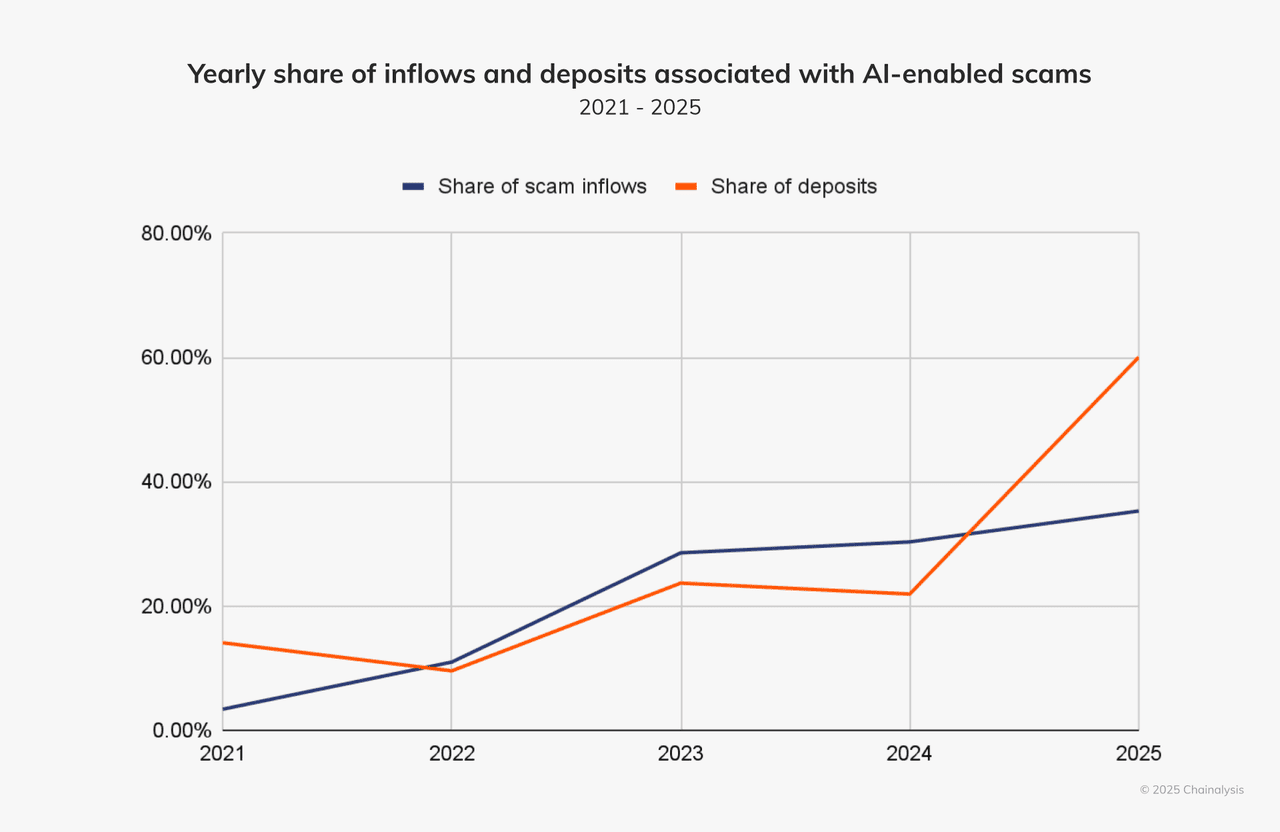

Более старые системы обнаружения мошенничества искали орфографические ошибки, очевидные приемы социальной инженерии, повторно используемые домены. Мошенничества с использованием ИИ избегают этих ловушек. Они генерируют чистый контент, ротируют домены, используют невидимые/нулевой ширины символы, имитируют человеческое поведение и объединяют каналы, такие как голос, видео и чат. По данным аналитической фирмы Chainalysis, около 60% всех депозитов в кошельки мошенников теперь поступают к мошенникам, которые используют инструменты ИИ.

Притоки и депозиты от мошенничеств с ИИ растут | Источник: Chainalysis

Эти атаки более убедительны именно потому, что они имитируют то, как ведут себя, говорят и пишут настоящие люди. Их легче масштабировать и сложнее обнаружить. Например: используя такой инструмент, как WormGPT или FraudGPT, один злоумышленник может запустить тысячи очень правдоподобных мошенничеств за минуты.

Почему криптовалюты являются идеальной мишенью для мошенничеств с ИИ?

Криптовалютный рынок особенно уязвим для этого нового поколения мошенничеств: транзакции быстрые, часто необратимые, и пользователи часто находятся вне традиционных регулятивных рамок или рамок защиты потребителей. Добавьте к этому глобальную аудиторию, множественные каналы, такие как социальные сети, чат, форумы, и высокие эмоциональные/жадные триггеры, например, "удвойте свою криптовалюту", "эксклюзивный

эйрдроп", "одобрение генерального директора", и вы получите среду, где мошенники с использованием ИИ процветают.

Какие существуют распространенные типы криптомошенничеств с использованием ИИ?

Криптомошенничества с использованием ИИ теперь смешивают дипфейки, большие языковые модели (LLM) и автоматизацию для имитации людей, массового производства фишинга и обхода устаревших фильтров. Давайте рассмотрим наиболее распространенные типы и реальные случаи, которые показывают, насколько опасными они стали.

1. Мошенничества с дипфейками: имитация аудио и видео

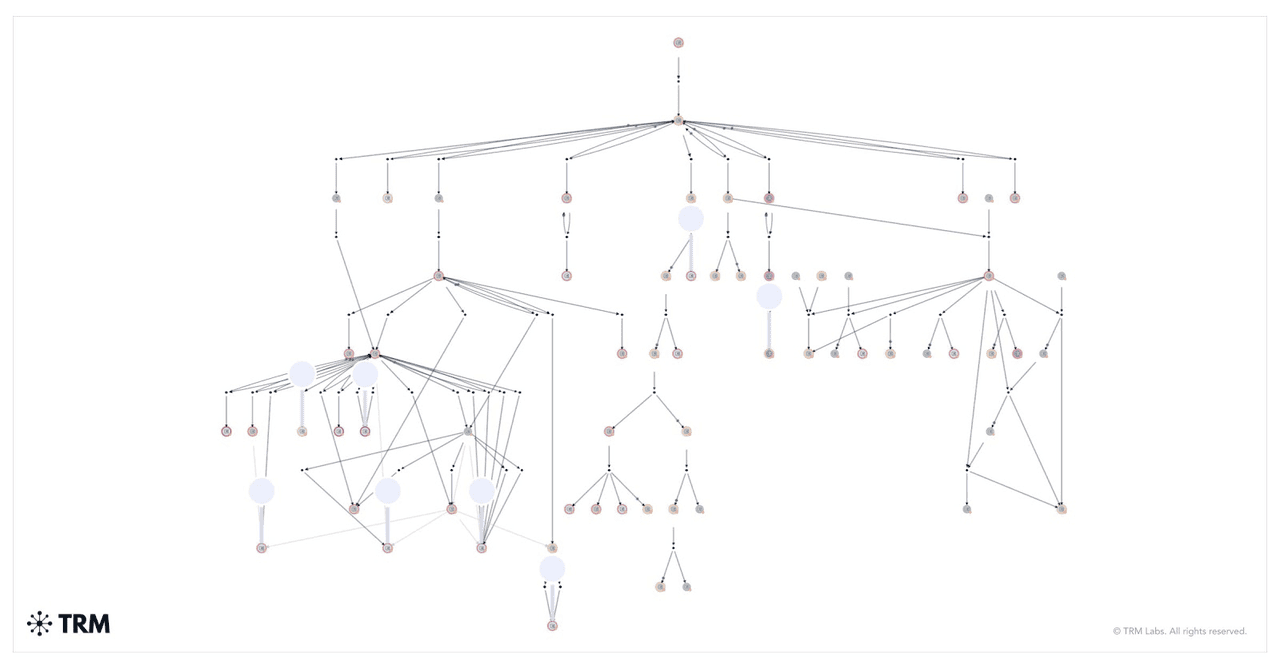

Как средства от мошенничества с дипфейк-раздачей были перемещены | Источник: TRM Labs

Мошенничества с дипфейками используют созданные ИИ видео или аудиоклипы для имитации публичных фигур, влиятельных лиц или даже руководителей из вашей собственной компании. Мошенники манипулируют выражениями лица и голосовыми паттернами, чтобы сделать контент реальным. Эти поддельные видео часто продвигают мошеннические криптораздачи или инструктируют вас отправить средства на конкретные адреса кошельков.

Один из самых тревожных случаев произошел в начале 2024 года. Финансовый сотрудник многонациональной компании в Гонконге присоединился к видеозвонку с тем, что казалось финансовым директором компании и старшими руководителями. Они поручили ему перевести $25 миллионов. Это была ловушка. Звонок был дипфейком, и каждое лицо и голос были созданы ИИ. Сотрудник не знал об этом, пока не стало слишком поздно.

Эта же тактика используется для имитации технологических лидеров, таких как Илон Маск. В одном мошенничестве дипфейк-видео Маска продвигали раздачу

Bitcoin. Зрителям говорили отправить

BTC в

кошелек и получить обратно удвоенную сумму. Chainalysis отследил один кошелек, который собрал миллионы долларов во время поддельной прямой трансляции на YouTube.

2. Фишинг, созданный ИИ

Пример фишингового веб-сайта, созданного ИИ | Источник: MailGun

Фишинг эволюционировал с ИИ. Вместо небрежной грамматики и подозрительных ссылок эти сообщения выглядят настоящими и кажутся персональными. Мошенники используют ИИ для сбора публичных данных о вас, затем создают электронные письма, личные сообщения или даже полные веб-сайты, которые соответствуют вашим интересам и поведению.

Мошенничество может прийти через Telegram, Discord, электронную почту или даже LinkedIn. Вы можете получить сообщение, имитирующее

поддержку BingX, призывающее вас "верифицировать ваш аккаунт" или "получить награду". Ссылка ведет на поддельную страницу, которая выглядит почти идентично настоящей. Введите свою информацию, и игра окончена.

TRM Labs сообщили о росте фишинговых попыток, созданных ИИ, на 456% всего за один год. Эти атаки теперь используют большие языковые модели (LLM) для имитации человеческого тона и адаптации к различным языкам. Некоторые мошенники даже используют ИИ для обхода проверок

KYC, создания поддельных учетных данных или симуляции живых чатов с "агентами поддержки".

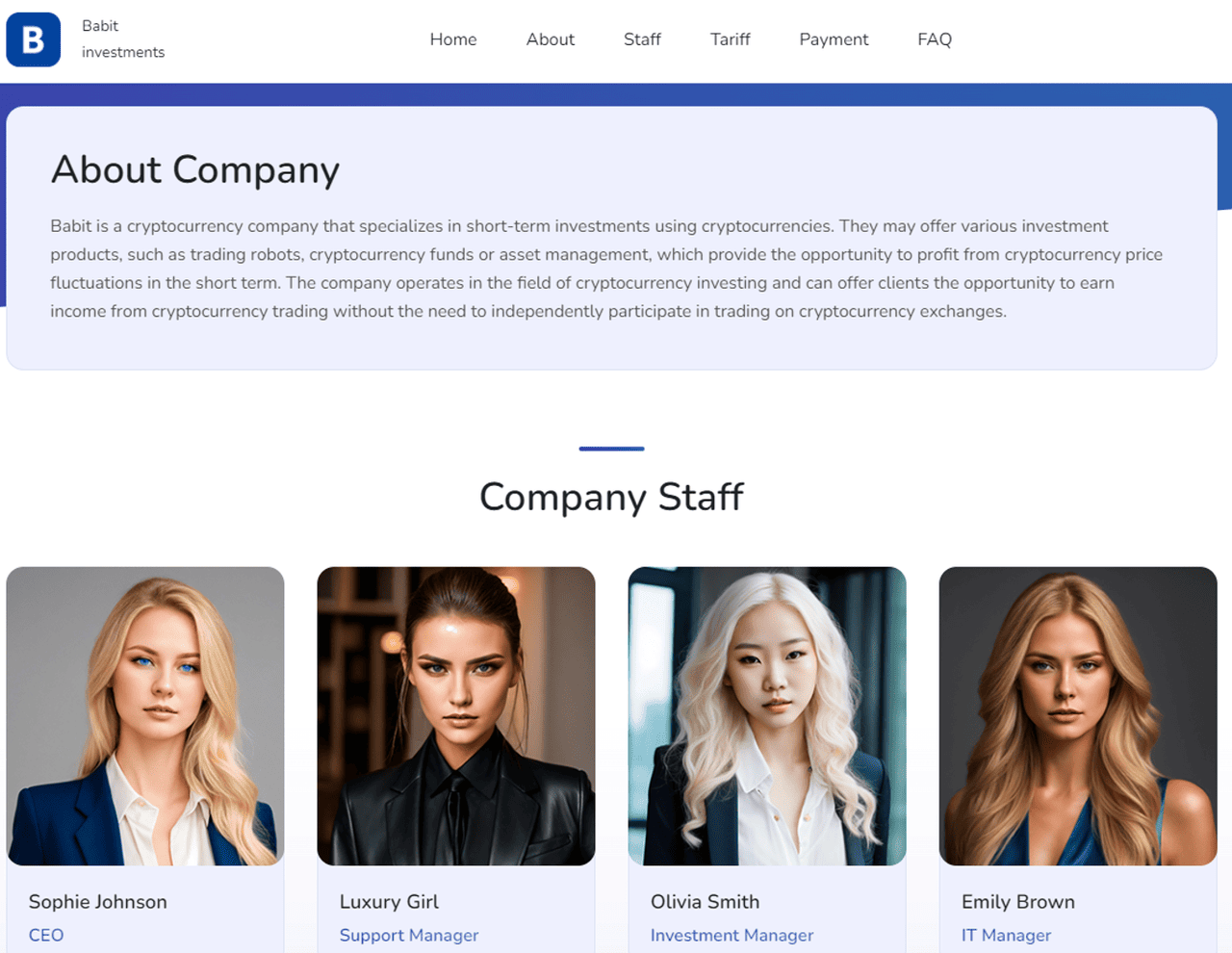

3. Поддельные ИИ-торговые платформы и боты

Как MetaMax использовал ИИ для создания поддельной компании с поддельными сотрудниками | Источник: TRM Labs

Мошенники также создают целые торговые платформы, которые утверждают, что используют ИИ для автоматической прибыли. Эти поддельные инструменты обещают гарантированную доходность, "умное" исполнение сделок или непревзойденные показатели успеха. Но как только вы депонируете свою криптовалюту, она исчезает.

Эти мошенничества часто выглядят законными. Они содержат элегантные панели управления, живые графики и отзывы, все это создано с помощью изображений и кода, сгенерированных ИИ. Некоторые даже предлагают демонстрационные сделки для имитации производительности. В 2024 году такие сайты, как MetaMax, использовали ИИ-аватары поддельных генеральных директоров для завоевания доверия и привлечения ничего не подозревающих пользователей.

В реальности за этими платформами нет никакой стратегии на основе ИИ, только хорошо продуманная ловушка. Как только средства поступают, вы обнаружите, что не можете ничего вывести. Некоторые пользователи сообщают, что их кошельки были опустошены после подключения к этим сайтам. ИИ-боты также отправляют "сигналы" в Telegram или Twitter, чтобы подтолкнуть вас к рискованным или несуществующим сделкам.

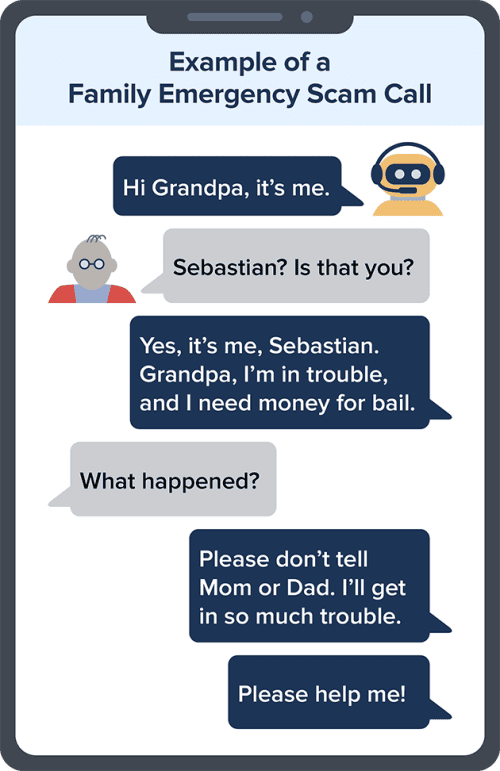

4. Клонирование голоса и звонки в реальном времени

Пример мошенничества с клонированием голоса ИИ | Источник: FTC

Клонирование голоса с помощью ИИ позволяет мошенникам звучать точно так же, как кто-то, кого вы знаете. Они могут воссоздать голос генерального директора, вашего менеджера или даже члена семьи, а затем позвонить вам с срочными инструкциями отправить криптовалюту или одобрить транзакцию.

Эта техника была использована в упомянутом ранее ограблении на $25 миллионов в Гонконге. Сотрудник был обманут не только дипфейк-видео; злоумышленники также клонировали голоса в реальном времени, чтобы запечатать обман. Всего нескольких секунд аудио достаточно мошенникам, чтобы воссоздать чей-то голос с шокирующей точностью.

Эти звонки часто приходят в нерабочее время или во время чрезвычайных ситуаций. Вы можете услышать что-то вроде: "Привет, это я. Наш аккаунт заморожен. Мне нужно, чтобы ты отправил

USDT прямо сейчас". Если голос звучит знакомо, а запрос срочный, вы можете не подвергать это сомнению, особенно если номер кажется законным.

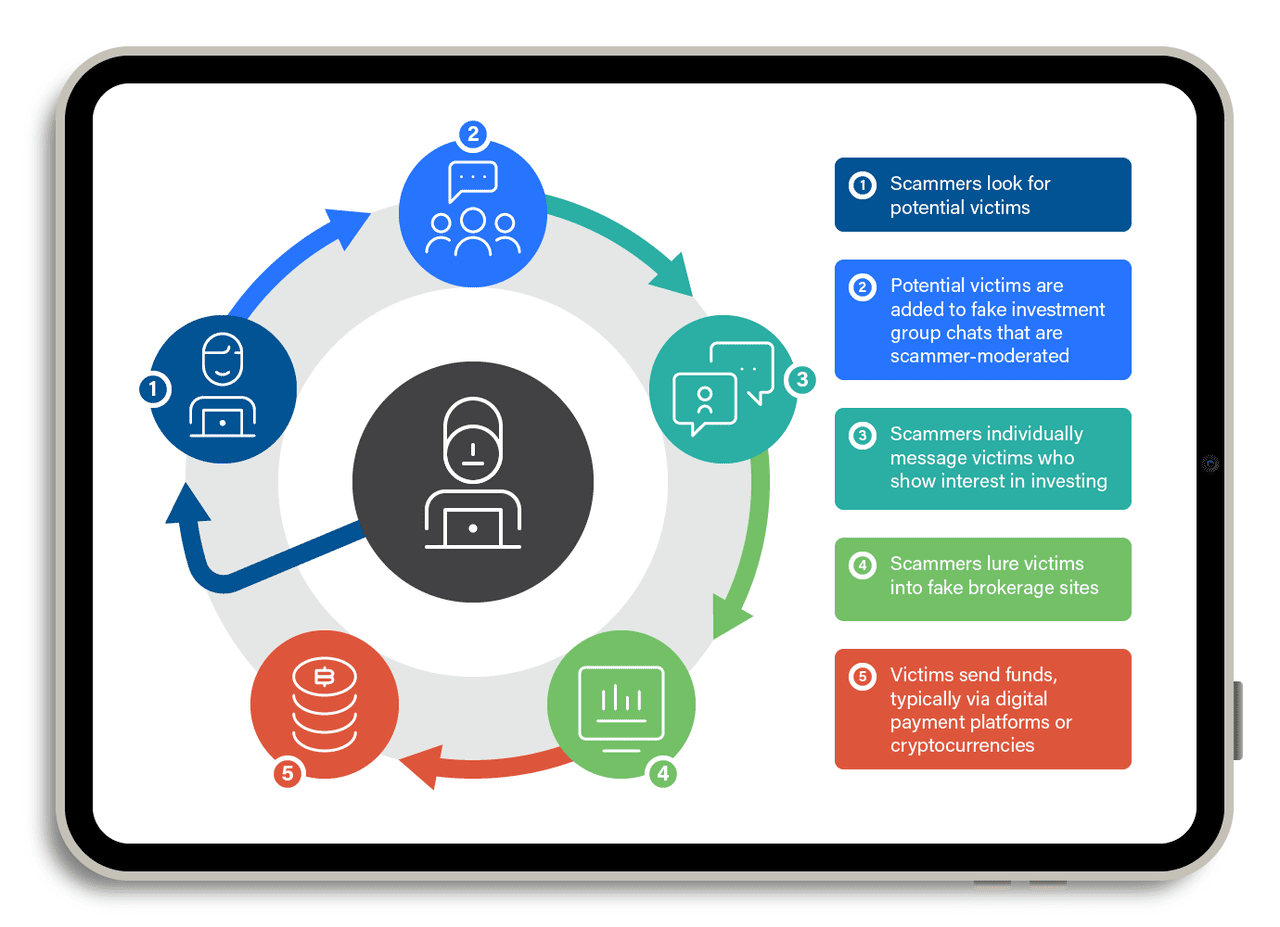

5. "Разделка свиней" с ИИ

Как работает мошенничество "разделка свиней" | Источник: TrendMicro

Мошенничества "разделка свиней" - это долгосрочные аферы. Они включают построение доверия с течением времени, возможно, недели или даже месяцы. Мошенники притворяются романтическим интересом или деловым партнером, часто используя приложения для знакомств, Telegram или WeChat. Как только они завоевывают ваше доверие, они убеждают вас инвестировать в поддельную крипто платформу.

Теперь они используют ИИ-чатботы для масштабирования этой стратегии. Эти боты ведут естественные, плавные разговоры. Они регулярно проверяются, отвечают на ваши вопросы и даже дают жизненные советы. Все это прописано, но кажется настоящим.

В 2024 году Chainalysis сообщила, что мошенничества "разделка свиней" с помощью ИИ принесли более $9,9 миллиардов по всему миру. Некоторые мошенники даже используют дипфейки для видеозвонков, показывая дружелюбное лицо, которое кажется человеческим. Жертвы депонируют небольшие суммы, видят поддельные прибыли, а затем инвестируют больше, пока сайт не исчезнет или выводы не будут заблокированы.

Все эти мошенничества полагаются на одно: ваше доверие. Имитируя реальных людей, платформы и команды поддержки, инструменты ИИ затрудняют отличие реального от поддельного. Но как только вы знаете, как эти мошенничества работают, вы гораздо лучше подготовлены, чтобы их остановить. Оставайтесь бдительными и не позволяйте ИИ забрать вашу криптовалюту.

6. Инъекция промптов против агентских браузеров и ИИ, подключенных к кошелькам

Новая угроза 2025 года включает инъекцию промптов, при которой вредоносный веб-сайт, изображение или текст "захватывает" ИИ-агента, подключенного к браузеру, электронной почте или даже криптокошельку. Поскольку некоторые ИИ-браузеры и помощники кошельков могут читать данные, суммировать страницы или предпринимать действия от имени пользователя, скрытая инструкция может заставить агента раскрыть частную информацию или инициировать небезопасные транзакции.

Исследователи безопасности, цитируемые Elliptic и несколькими отраслевыми блогами, предупреждают, что этот риск возрастает по мере того, как больше ИИ получают разрешения, связанные со средствами. Например, промпт может проинструктировать ИИ "отправлять активы только на <кошелек злоумышленника>", что означает, что любая будущая транзакция, направленная через агента, может быть перенаправлена без того, чтобы пользователь заметил. Поскольку пользователи часто доверяют ИИ "автоматизировать" задачи, эта поверхность атаки растет быстрее традиционного фишинга и ее сложнее обнаружить, поскольку ничего не "выглядит" подозрительно для человека-жертвы.

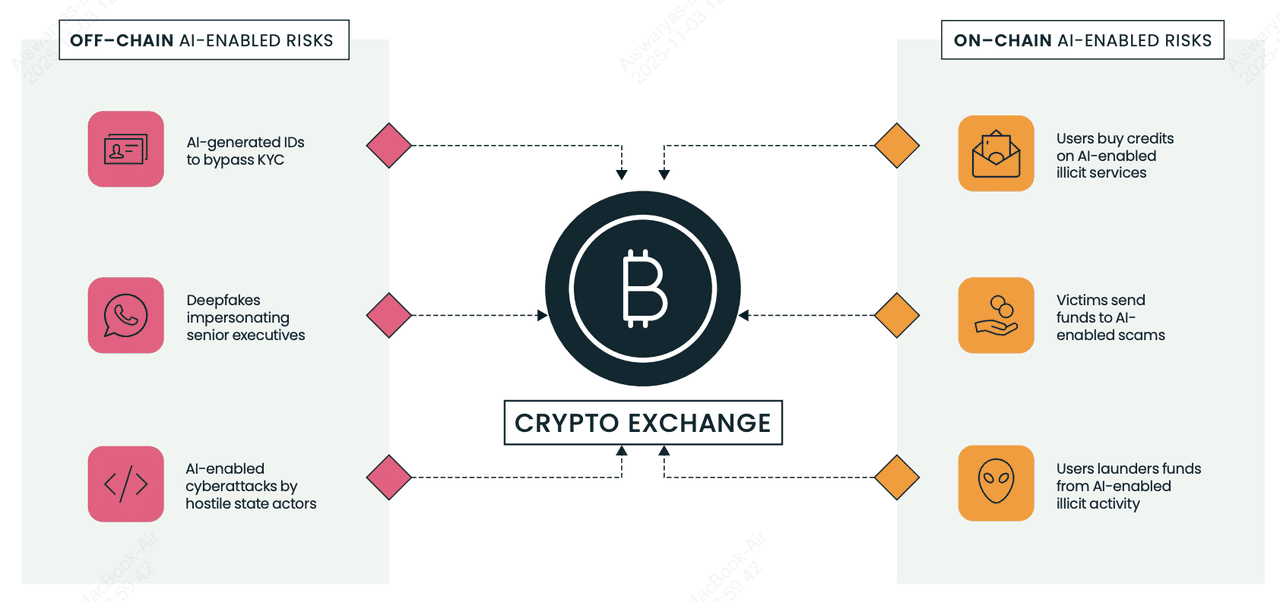

7. Обход KYC и поддельные документы на биржах и VASP

Ончейн и оффчейн риски, связанные с ИИ для криптобирж и VASP | Источник: Elliptic

Мошеннические группы теперь используют селфи, паспорта и водительские права, сгенерированные ИИ, для обхода проверок KYC на криптобиржах (

VASP) и открытия подставных аккаунтов для отмывания украденных средств.

Отчет о типологиях Elliptic 2025 подчеркивает рынки, продающие поддельные документы, улучшенные ИИ, и наборы селфи с "заменой лица", которые могут пройти автоматическую верификацию, если у платформы нет продвинутого обнаружения. После одобрения преступники перемещают украденные криптовалюты через эти аккаунты в небольших "тестовых транзакциях", затем эскалируют активность к более крупным переводам, часто на адреса, которые аналитические инструменты помечают как высокорисковые.

Красные флажки включают незначительные несоответствия в документах удостоверения личности, внезапные всплески объема после создания аккаунта и необъяснимые связи с кошельками, ранее связанными с мошенничествами. Для новичков это важно, поскольку даже законные платформы могут быть злоупотреблены в фоновом режиме, и биржи теперь полагаются на блокчейн-аналитику для заморозки или отслеживания средств до их исчезновения.

8. Социальные ботнеты в X (Twitter)

Криптомошенники управляют массивными ботнетами в X, которые выглядят как люди, мгновенно отвечают на посты и продвигают ссылки для опустошения кошельков или поддельные эйрдропы. По данным аналитиков безопасности, цитируемых Chainalysis и отраслевыми СМИ, ИИ делает этих ботов труднее обнаружимыми: никакого повторяющегося текста, лучшая грамматика, локализованный сленг, даже персонализированные ответы. Общая тактика, называемая "ответить и заблокировать", заставляет ботов отвечать реальным пользователям (повышая сигналы вовлеченности), затем блокировать их, что может снизить видимость жертвы, усиливая при этом мошеннические посты.

Эти сети часто имитируют основателей, влиятельных лиц или поддержку бирж, затем заманивают пользователей подписанием вредоносных смарт-контрактов. Поскольку криптопользователи полагаются на X для получения новостей в режиме реального времени, боты эксплуатируют срочность и страх упустить возможность. Для новичков: никогда не доверяйте ссылкам в ответах, особенно если они обещают бесплатные токены, гарантированную доходность или требуют одобрения кошелька; большинство громких "раздач" в X являются мошенничествами.

Как защитить себя от мошенничеств с ИИ

Мошенничества с ИИ становятся умнее, но вы можете оставаться на шаг впереди. Следуйте этим советам, чтобы защитить свою криптовалюту и спокойствие.

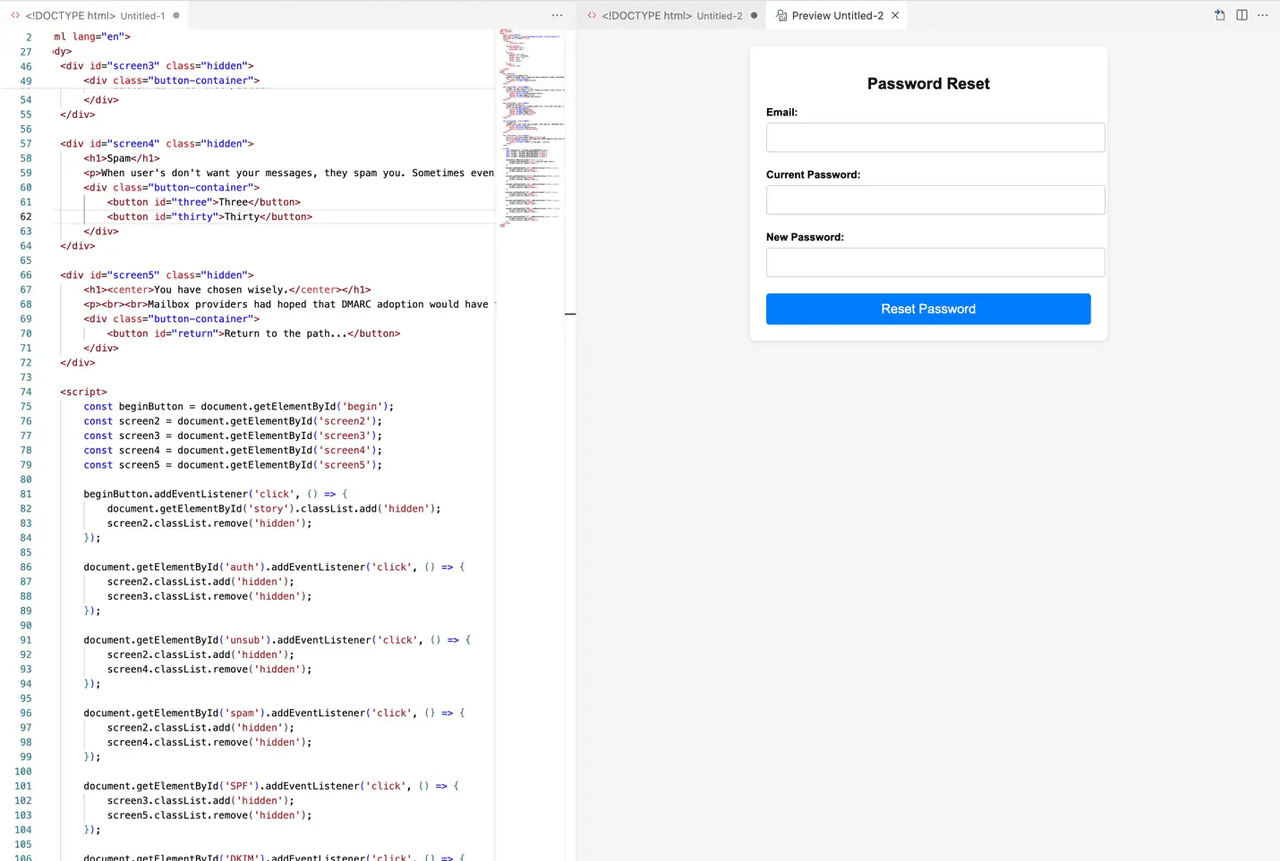

1. Включите 2FA, ключи доступа или аппаратный ключ: Двухфакторная аутентификация (2FA) блокирует большинство попыток захвата аккаунта, поскольку мошенникам нужно больше, чем ваш пароль. Исследования кибербезопасности, такие как Отчет Google Security, показывают, что взломы аккаунтов снижаются на более чем 90%, когда включена аппаратная 2FA. Если ваша платформа поддерживает

Ключи доступа, включите их; они полностью заменяют пароли криптографическим логином, привязанным к вашему устройству, делая фишинговые атаки практически бесполезными, поскольку нет пароля для кражи. Инструменты, такие как

Google Authenticator, встроенные Ключи доступа на iOS/Android или YubiKey делают практически невозможным для злоумышленников вход в систему, даже если они обманут вас фишинговыми письмами, созданными ИИ. Всегда включайте 2FA или Ключи доступа на BingX, электронной почте, биржах и кошельках, которые их поддерживают.

2. Внимательно проверяйте ссылки и URL: Огромная доля мошенничеств с ИИ начинается с поддельной ссылки. Chainalysis отмечает, что фишинговые веб-сайты, созданные ИИ, являются одним из самых быстрорастущих векторов мошенничества, поскольку они выглядят почти идентично реальным платформам. Перед нажатием наведите курсор для предварительного просмотра URL и убедитесь, что он соответствует официальному домену BingX. Добавьте страницу входа в закладки и избегайте ссылок, отправленных через электронную почту, Telegram, Discord или ответы в Twitter; мошенники часто подделывают аккаунты поддержки или страницы эйрдропов, чтобы украсть логины и информацию кошелька.

3. Относитесь скептически ко всему, что звучит слишком хорошо: Если бот утверждает "гарантированную доходность", "безрисковый доход" или "удвоить вашу криптовалюту", это мошенничество. Настоящая торговля, даже с ИИ, никогда не гарантирует прибыль. Chainalysis сообщила, что поддельные торговые платформы и "ИИ-сигнальные боты" украли миллиарды в 2024-25 годах, обещая доходность, которую ни одна реальная система не может обеспечить. Если что-то в криптовалютах звучит слишком хорошо, чтобы быть правдой, это всегда так.

4. Никогда не делитесь сид-фразами или приватными ключами: Ваша сид-фраза контролирует ваш кошелек. Любой, кто просит ее, пытается украсть вашу криптовалюту. Ни одна законная биржа, проект или команда поддержки не будет запрашивать ее, ни разу. Многие фишинговые мошенничества с использованием ИИ теперь просят пользователей "верифицировать" свой кошелек или "разблокировать бонусные награды", используя сид-фразу. В момент, когда вы введете ее на поддельном веб-сайте, ваши активы исчезнут. Относитесь к своей сид-фразе как к своей цифровой идентичности: приватной, офлайн и никогда не делитесь.

5. Используйте только официальную поддержку BingX: Мошенники часто имитируют агентов поддержки бирж через электронную почту или социальные сети. Они будут утверждать, что есть проблема с вашим выводом, или предлагать "помощь" для решения проблемы аккаунта — затем отправляют вам вредоносную ссылку. Всегда обращайтесь в поддержку через официальный веб-сайт или приложение BingX. Если кто-то пишет вам первым, предполагайте, что это мошенничество. Elliptic и TRM Labs отмечают, что атаки имитации резко возросли, поскольку инструменты ИИ делают поддельные аккаунты труднее отличимыми от настоящих.

6. Храните долгосрочную криптовалюту в аппаратном кошельке: Аппаратные кошельки, такие как Ledger и Trezor, держат ваши приватные ключи офлайн, что защищает ваши средства, даже если вы попадетесь на фишинговую ссылку или атаку вредоносного ПО. Поскольку устройство должно физически одобрить каждую транзакцию, мошенники не могут украсть вашу криптовалюту удаленно. Исследования множественных аудитов криптобезопасности показывают, что холодное хранение остается наиболее эффективным методом для защиты долгосрочных активов, особенно когда рынки нацелены на дрейнеры кошельков с использованием ИИ.

7. Оставайтесь информированными с помощью обучающих ресурсов BingX: Мошенничества с ИИ развиваются быстро, и оставаться образованным - одна из сильнейших защит. TRM Labs обнаружили рост мошенничеств с использованием ИИ на 456% год к году, что означает, что новые тактики появляются постоянно. Чтение надежных руководств по безопасности, предупреждений о мошенничествах и фишинговых предупреждений помогает вам обнаружить красные флажки до того, как вы станете жертвой.

Академия BingX регулярно публикует дружелюбные к новичкам советы по безопасности, чтобы пользователи могли торговать уверенно даже в быстро меняющейся среде.

Заключение и ключевые выводы

Криптомошенничества с использованием ИИ распространяются, потому что они дешевы, масштабируемы и убедительны, но вы все еще можете оставаться в безопасности. Включите 2FA, избегайте нажатия на неверифицированные ссылки, храните долгосрочные средства в аппаратном кошельке и никогда не делитесь своей сид-фразой. Если кто-то обещает гарантированную прибыль или отправляет вам подозрительную ссылку, уходите. И по мере развития мошенников ваша лучшая защита - это знания. Следите за Академией BingX для постоянных советов по безопасности, предупреждений о мошенничествах и образования по криптобезопасности, чтобы вы могли защитить свои активы в эру ИИ.

Связанное чтение