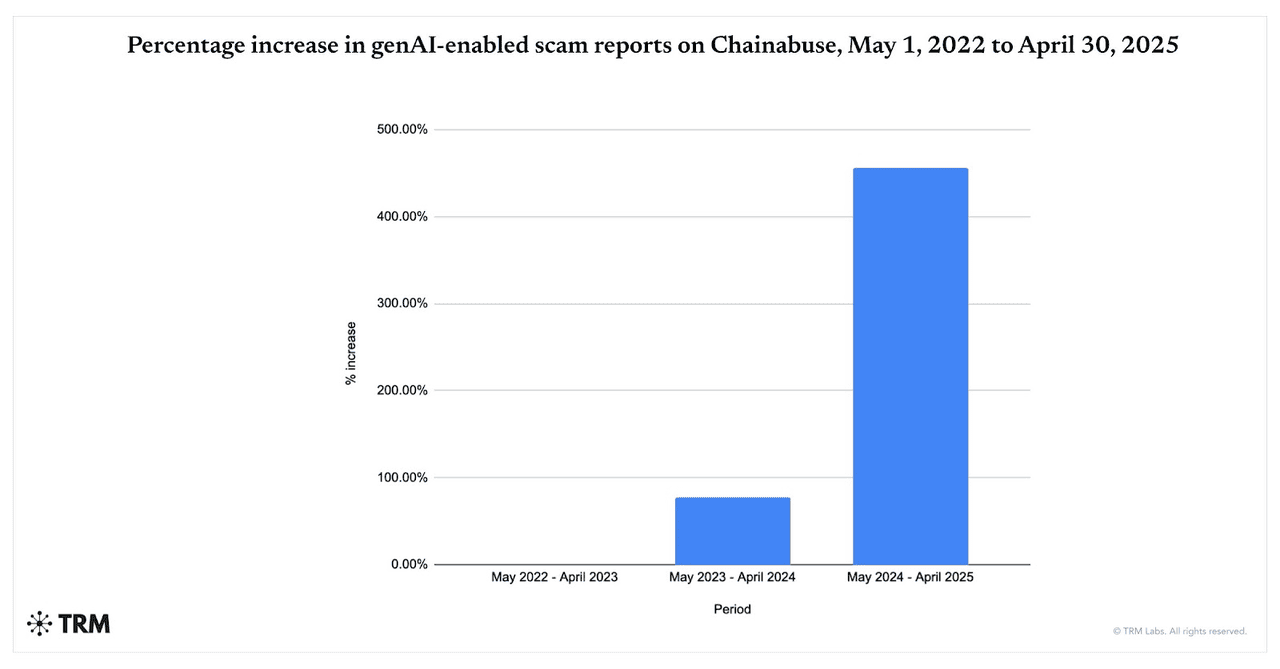

KI-gestützte Betrugsversuche nehmen zu. Zwischen Mai 2024 und April 2025 stiegen die Meldungen über Gen-KI-basierte Betrügereien laut TRM Labs' Chainabuse-Daten um 456%. Chainalysis stellt außerdem fest, dass 60% der Einzahlungen in Betrugs-Wallets nun zu Betrügereien fließen, die KI-Tools nutzen, ein scharfer Anstieg gegenüber 2024, was unterstreicht, wie weit verbreitet Betrüger LLMs, Deepfakes und Automatisierung einsetzen.

KI-basierte Betrügereien steigen von 2022 bis 2025 stark an | Quelle: TRM Labs

Was treibt den Anstieg von KI-gestützten Krypto-Betrügereien im Jahr 2025 an? KI bietet Geschwindigkeit, Skalierung und Realismus: ein Betreiber kann in Minuten Tausende von maßgeschneiderten Phishing-Ködern, Deepfake-Videos/Stimmen und Markenimitationen erstellen, Inhalte, die herkömmliche Filter umgehen und Opfer überzeugen. Stand November 2025 haben neue Angriffsflächen wie Prompt-Injection gegen agentenbasierte Browser und KI-Copilots das Risiko erhöht, dass bösartige Webseiten oder Screenshots Assistenten kapern können, die mit Wallets oder Konten verbunden sind.

Und Krypto bleibt ein Hauptziel: schnelllebige Märkte, irreversible Transaktionen und 24/7 On-Chain-Abrechnung erschweren die Wiederherstellung, während breitere Kriminalitätstrends 2025 von Hacks bis zu Pig-Butchering zeigen, dass das Gesamtrisiko des Krypto-Ökosystems steigt.

In diesem Leitfaden erfahren Sie, was KI-Krypto-Betrügereien sind, wie sie funktionieren und wie Sie sicher bleiben, wenn Sie Handelsplattformen, einschließlich BingX, nutzen.

Was sind KI-gestützte Krypto-Betrügereien und wie funktionieren sie?

KI-gestützte Krypto-Betrügereien nutzen fortgeschrittene

künstliche Intelligenz-Techniken, um Sie zu täuschen und Ihr Geld, private Schlüssel oder Anmeldedaten zu stehlen. Diese Betrügereien gehen weit über die althergebrachten

Phishing-Schemata hinaus. Sie sind intelligenter, schneller und weitaus glaubwürdiger als je zuvor.

Herkömmlicher Krypto-Betrug beinhaltete typischerweise manuelle Taktiken: schlecht geschriebene E-Mails, generische Social-Media-Giveaways oder offensichtliche Identitätsdiebstähle. Diese waren einfacher zu erkennen, wenn man wusste, wonach man suchte.

KI-basierte Krypto-Betrügereien wachsen mit explosiver Geschwindigkeit. TRM Labs berichtet von einem 456%igen Anstieg der generativen KI-Betrugsaktivität zwischen Mai 2024 und April 2025, während Chainalysis feststellt, dass etwa 60% aller Einzahlungen in Betrugs-Wallets nun aus Operationen stammen, die KI-Tools verwenden. Parallel dazu bemerkt The Defiant, dass KI-gesteuerte Krypto-Betrügereien bis Mai 2025 um fast 200% im Jahresvergleich wuchsen, was zeigt, wie schnell Betrüger Deepfakes, automatisierte Bots und KI-generiertes Phishing einsetzen, um Nutzer in großem Maßstab anzugreifen.

Aber jetzt verändert KI das Spiel. Betrüger nutzen generative KI, maschinelle Lern-Bots, Stimmenklonen und Deepfake-Videos, um:

1. Realistische und personalisierte Inhalte zu erstellen, die menschlich wirken

KI-Tools können Phishing-E-Mails und gefälschte Nachrichten generieren, die klingen und sich lesen, als kämen sie von einem vertrauenswürdigen Freund, Influenzer oder einer Plattform. Sie verwenden tadellose Grammatik, imitieren Sprachmuster und fügen sogar persönliche Details basierend auf Ihrem Online-Verhalten ein. Deepfake-Videos und Stimmenklone treiben dies weiter: Sie könnten wirklich glauben, dass ein CEO, eine Berühmtheit oder ein Bekannter zu Ihnen spricht.

2. Massive Angriffe mit Blitzgeschwindigkeit zu starten

Mit generativer KI und großen Sprachmodellen (LLMs) können Betrüger in Sekunden Tausende von Phishing-Nachrichten, gefälschte Websites oder Imitationsbots produzieren. Diese Nachrichten können lokalisiert, personalisiert und über E-Mail, Telegram, Discord, SMS und soziale Medien verbreitet werden. Was früher spezielle Teams erforderte, kann jetzt von einem einzigen Betreiber mit den richtigen Tools erledigt werden.

3. Traditionelle Filter und Sicherheitssysteme zu umgehen

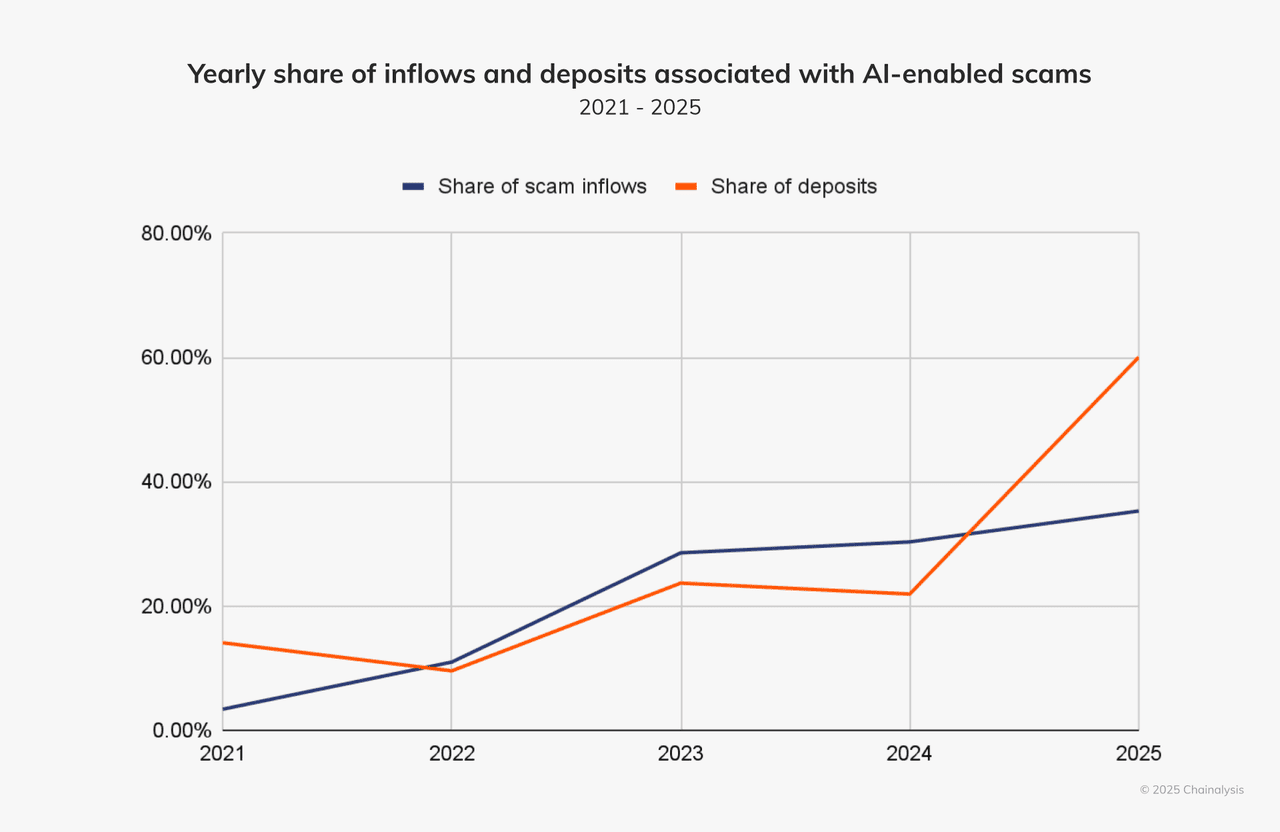

Ältere Betrugserkennungssysteme suchten nach Rechtschreibfehlern, offensichtlichen Social-Engineering-Hinweisen, wiederverwendeten Domains. KI-gestützte Betrügereien vermeiden diese Fallen. Sie generieren saubere Texte, rotieren Domains, verwenden unsichtbare/null-breite Zeichen, imitieren menschliches Verhalten und kombinieren Kanäle wie Stimme, Video und Chat. Laut der Analysefirma Chainalysis fließen etwa 60% aller Einzahlungen in Betrugs-Wallets nun zu Betrügereien, die KI-Tools nutzen.

Zuflüsse und Einzahlungen aus KI-Betrügereien nehmen zu | Quelle: Chainalysis

Diese Angriffe sind überzeugender, gerade weil sie nachahmen, wie sich echte Menschen verhalten, sprechen und schreiben. Sie sind einfacher zu skalieren und schwieriger zu entdecken. Zum Beispiel: Mit einem Tool wie WormGPT oder FraudGPT kann ein Angreifer in Minuten Tausende sehr glaubwürdige Betrügereien starten.

Warum ist Krypto ein ideales Ziel für KI-Betrügereien?

Der Krypto-Markt ist besonders anfällig für diese neue Generation von Betrügereien: Transaktionen sind schnell, oft irreversibel, und Nutzer befinden sich häufig außerhalb traditioneller regulatorischer oder Verbraucherschutzrahmen. Fügen Sie ein globales Publikum, mehrere Kanäle wie soziale Medien, Chat, Foren und hohe Emotions-/Gier-Trigger hinzu, z.B. „verdoppeln Sie Ihre Krypto", „exklusiver

Airdrop", „CEO-Empfehlung", und Sie haben eine Umgebung, in der KI-gestützte Betrüger gedeihen.

Was sind die häufigsten Arten von KI-gesteuerten Krypto-Betrügereien?

KI-gestützte Krypto-Betrügereien mischen jetzt Deepfakes, große Sprachmodelle (LLMs) und Automatisierung, um Personen zu imitieren, massenhaft Phishing zu produzieren und herkömmliche Filter zu umgehen. Lassen Sie uns die häufigsten Arten und reale Fälle erkunden, die zeigen, wie gefährlich sie geworden sind.

1. Deepfake-Betrügereien: Audio- und Video-Imitation

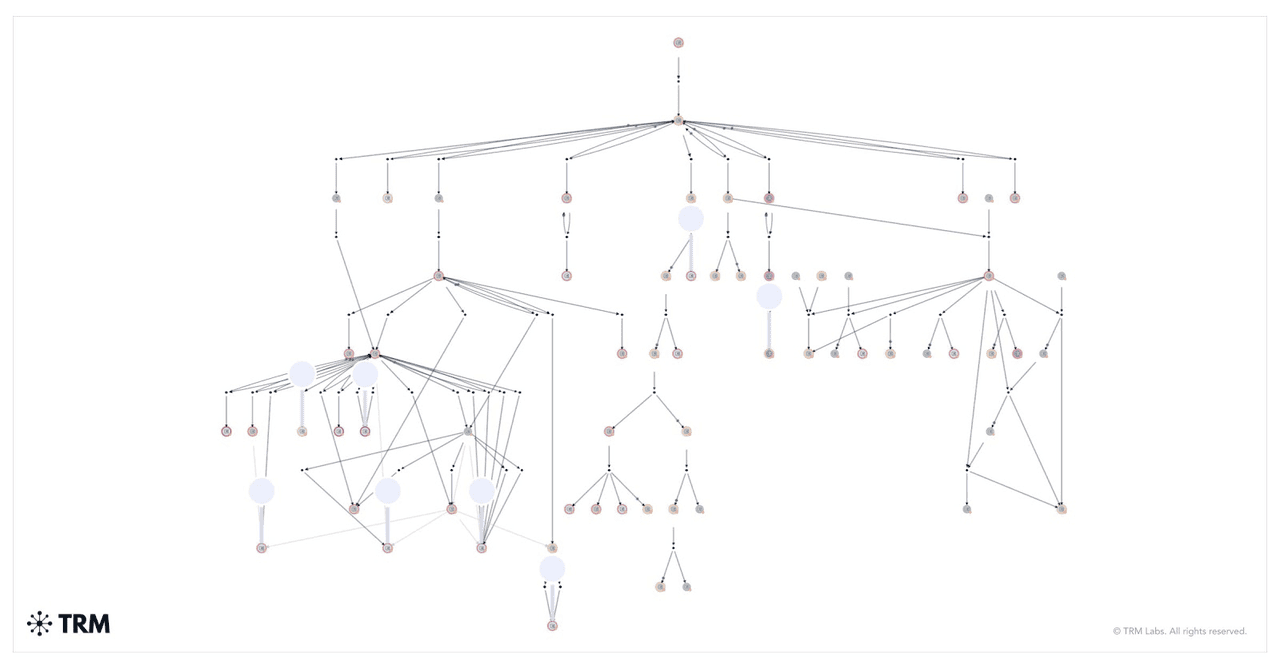

Wie die Gelder aus einem Deepfake-Giveaway-Betrug bewegt wurden | Quelle: TRM Labs

Deepfake-Betrügereien verwenden KI-generierte Videos oder Audio-Clips, um öffentliche Persönlichkeiten, Influenzer oder sogar Führungskräfte aus Ihrem eigenen Unternehmen zu imitieren. Betrüger manipulieren Gesichtsausdrücke und Stimmmuster, um den Inhalt echt erscheinen zu lassen. Diese gefälschten Videos bewerben oft betrügerische Krypto-Giveaways oder weisen Sie an, Gelder an bestimmte Wallet-Adressen zu senden.

Einer der alarmierendsten Fälle ereignete sich Anfang 2024. Ein Finanzangestellter bei einem multinationalen Unternehmen in Hongkong nahm an einem Videoanruf teil mit dem, was der CFO und leitende Führungskräfte des Unternehmens zu sein schienen. Sie wiesen ihn an, 25 Millionen Dollar zu überweisen. Es war eine Falle. Der Anruf war ein Deepfake, und jedes Gesicht und jede Stimme war von KI generiert. Der Angestellte wusste es nicht, bis es zu spät war.

Diese gleiche Taktik wird verwendet, um Tech-Führungskräfte wie Elon Musk zu imitieren. In einem Betrug bewarben Deepfake-Videos von Musk ein

Bitcoin-Giveaway. Zuschauer wurden aufgefordert,

BTC an eine

Wallet zu senden und den doppelten Betrag zurückzuerhalten. Chainalysis verfolgte eine einzige Wallet, die während eines gefälschten Livestreams auf YouTube Millionen von Dollar sammelte.

2. KI-generiertes Phishing

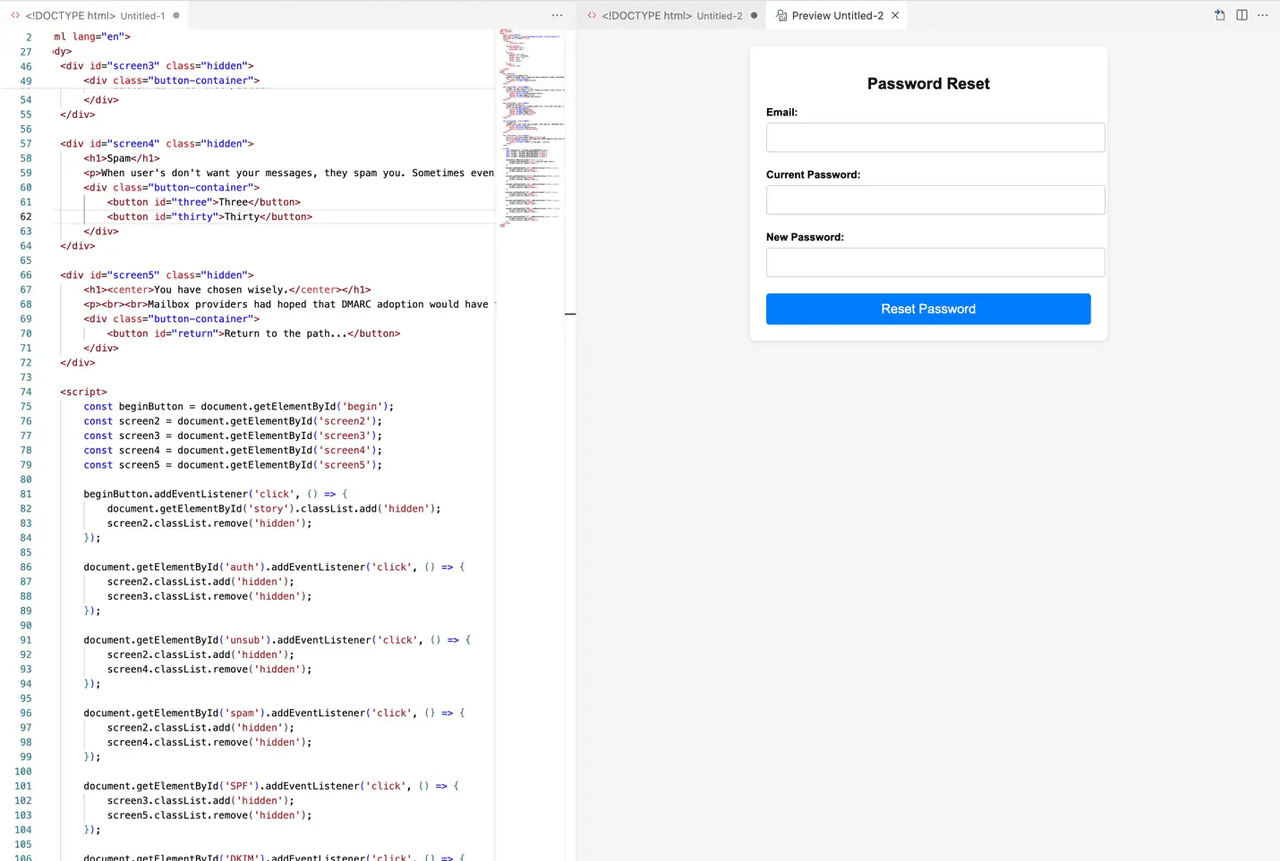

Beispiel einer KI-generierten Phishing-Website | Quelle: MailGun

Phishing hat sich mit KI weiterentwickelt. Anstatt schludriger Grammatik und verdächtiger Links sehen diese Nachrichten echt aus und wirken persönlich. Betrüger nutzen KI, um öffentliche Daten über Sie zu sammeln, dann erstellen sie E-Mails, Direktnachrichten oder sogar ganze Websites, die Ihren Interessen und Ihrem Verhalten entsprechen.

Der Betrug könnte über Telegram, Discord, E-Mail oder sogar LinkedIn kommen. Sie könnten eine Nachricht erhalten, die den

BingX Support imitiert und Sie auffordert, „Ihr Konto zu verifizieren" oder „eine Belohnung zu beanspruchen." Der Link führt zu einer gefälschten Seite, die fast identisch mit der echten aussieht. Geben Sie Ihre Informationen ein, und das Spiel ist vorbei.

TRM Labs berichtete über einen 456%igen Anstieg von KI-generierten Phishing-Versuchen in nur einem Jahr. Diese Angriffe verwenden jetzt große Sprachmodelle (LLMs), um menschlichen Ton zu imitieren und sich an verschiedene Sprachen anzupassen. Einige Betrüger nutzen sogar KI, um

KYC-Prüfungen zu umgehen, gefälschte Anmeldedaten zu generieren oder Live-Chats mit „Support-Agenten" zu simulieren.

3. Gefälschte KI-Handelsplattformen & Bots

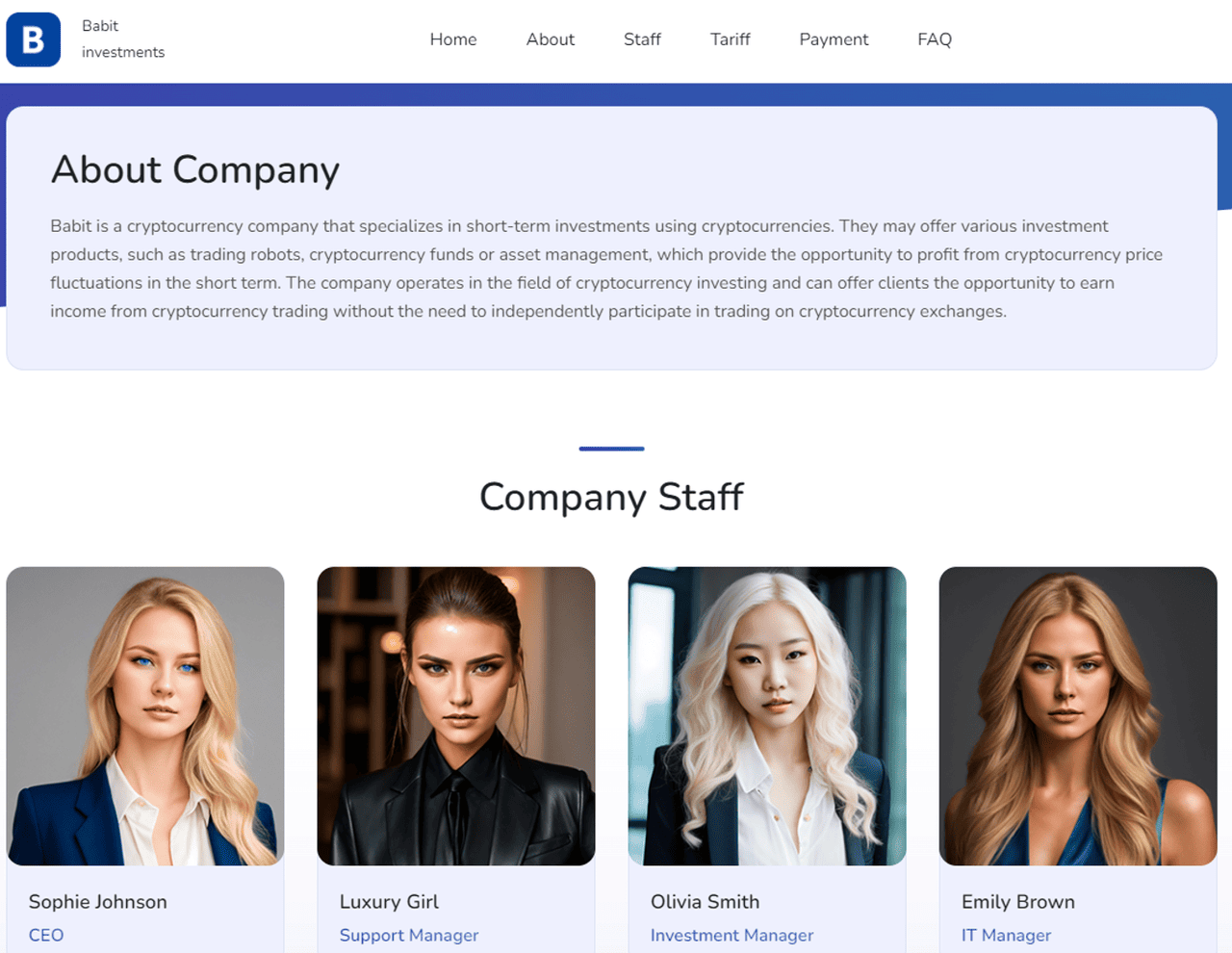

Wie MetaMax KI nutzte, um ein gefälschtes Unternehmen mit gefälschten Mitarbeitern zu erstellen | Quelle: TRM Labs

Betrüger bauen auch ganze Handelsplattformen auf, die behaupten, KI für automatische Gewinne zu nutzen. Diese gefälschten Tools versprechen garantierte Renditen, „intelligente" Handelsausführung oder unschlagbare Erfolgsraten. Aber sobald Sie Ihre Krypto einzahlen, verschwindet sie.

Diese Betrügereien sehen oft legitim aus. Sie verfügen über elegante Dashboards, Live-Charts und Testimonials, alle angetrieben von KI-generierten Bildern und Code. Einige bieten sogar Demo-Trades an, um Leistung vorzutäuschen. 2024 nutzten Websites wie MetaMax KI-Avatare gefälschter CEOs, um Vertrauen zu gewinnen und ahnungslose Nutzer anzulocken.

In Wirklichkeit gibt es keine KI-gestützte Strategie hinter diesen Plattformen, nur eine gut gestaltete Falle. Sobald Gelder eingehen, werden Sie feststellen, dass Sie nichts abheben können. Einige Nutzer berichten, dass ihre Wallets geleert wurden, nachdem sie sie mit diesen Websites verbunden hatten. KI-Bots senden auch „Signale" auf Telegram oder Twitter, um Sie zu riskanten oder nicht existierenden Trades zu drängen.

4. Stimmenklonen und Echtzeit-Anrufe

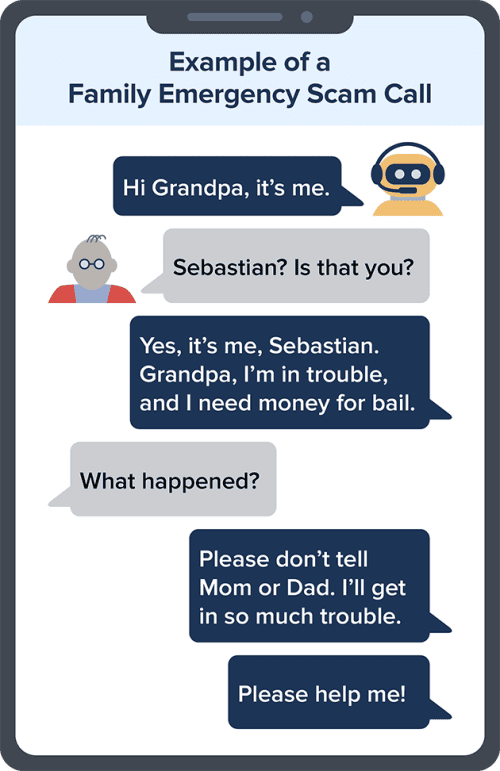

Beispiel eines KI-Stimmenklonen-Betrugs | Quelle: FTC

KI-Stimmenklonen ermöglicht es Betrügern, genau wie jemand zu klingen, den Sie kennen. Sie können die Stimme eines CEOs, Ihres Managers oder sogar eines Familienmitglieds nachbilden und Sie dann mit dringenden Anweisungen anrufen, Krypto zu senden oder eine Transaktion zu genehmigen.

Diese Technik wurde bei dem 25-Millionen-Dollar-Raubzug in Hongkong verwendet, der zuvor erwähnt wurde. Der Angestellte wurde nicht nur durch Deepfake-Videos getäuscht; die Angreifer klonten auch Stimmen in Echtzeit, um die Täuschung zu besiegeln. Nur wenige Sekunden Audio reichen aus, damit Betrüger jemandes Stimme mit schockierender Genauigkeit nachbilden können.

Diese Anrufe kommen oft außerhalb der Geschäftszeiten oder in Notfällen. Sie könnten etwas hören wie: „Hey, ich bin's. Unser Konto ist eingefroren. Ich brauche, dass du jetzt

USDT sendest." Wenn die Stimme vertraut klingt und die Bitte dringend ist, könnten Sie es nicht hinterfragen, besonders wenn die Nummer legitim erscheint.

5. Pig-Butchering mit KI

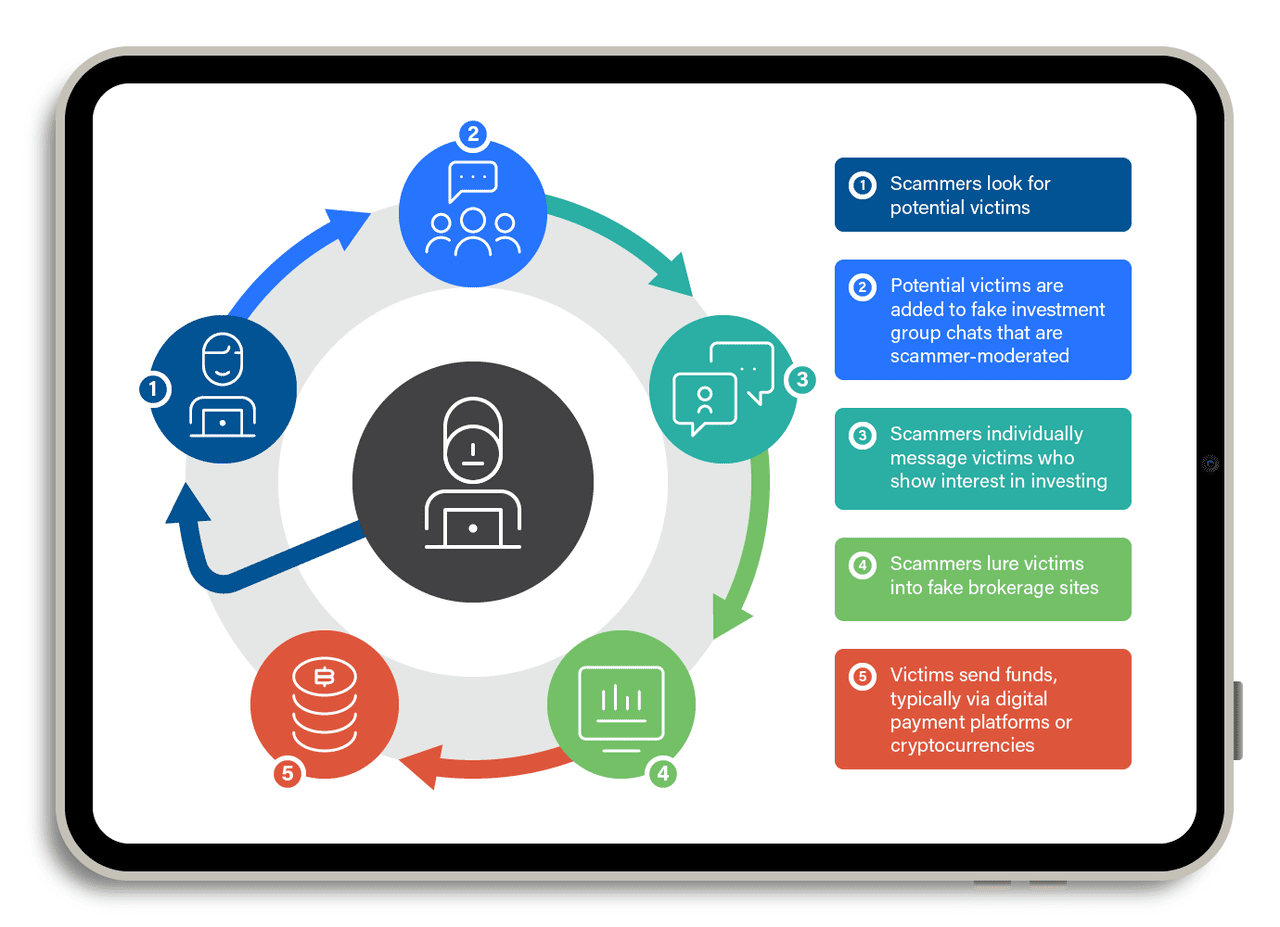

Wie ein Pig-Butchering-Betrug funktioniert | Quelle: TrendMicro

„Pig-Butchering"-Betrügereien sind langwierige Betrugsversuche. Sie beinhalten den Aufbau von Vertrauen über Zeit, vielleicht Wochen oder sogar Monate. Betrüger geben vor, ein romantisches Interesse oder Geschäftspartner zu sein, oft über Dating-Apps, Telegram oder WeChat. Sobald sie Ihr Vertrauen gewonnen haben, überzeugen sie Sie, in eine gefälschte Krypto-Plattform zu investieren.

Jetzt verwenden sie KI-Chatbots, um diese Strategie zu skalieren. Diese Bots führen natürliche, fließende Gespräche. Sie folgen regelmäßig nach, beantworten Ihre Fragen und bieten sogar Lebensberatung. Es ist alles geskriptet, aber es fühlt sich echt an.

2024 berichtete Chainalysis, dass KI-unterstützte Pig-Butchering-Betrügereien global über 9,9 Milliarden Dollar einbrachten. Einige Betrüger verwenden sogar Deepfakes für Videoanrufe und zeigen ein freundliches Gesicht, das menschlich zu sein scheint. Opfer zahlen kleine Beträge ein, sehen gefälschte Gewinne und investieren dann mehr, bis die Website verschwindet oder Abhebungen blockiert werden.

Diese Betrügereien beruhen alle auf einer Sache: Ihrem Vertrauen. Durch die Nachahmung echter Personen, Plattformen und Support-Teams machen KI-Tools es schwieriger zu unterscheiden, was echt und was gefälscht ist. Aber sobald Sie wissen, wie diese Betrügereien funktionieren, sind Sie viel besser darauf vorbereitet, sie zu stoppen. Bleiben Sie wachsam und lassen Sie KI nicht Ihre Krypto nehmen.

6. Prompt-Injection gegen agentenbasierte Browser und Wallet-verbundene KIs

Eine neue Bedrohung in 2025 betrifft Prompt-Injection, bei der eine bösartige Website, ein Bild oder Text einen KI-Agenten „kapert", der mit einem Browser, E-Mail oder sogar einer Krypto-Wallet verbunden ist. Da einige KI-Browser und Wallet-Copilots Daten lesen, Seiten zusammenfassen oder Aktionen im Namen eines Nutzers durchführen können, kann eine versteckte Anweisung den Agenten zwingen, private Informationen preiszugeben oder unsichere Transaktionen zu initiieren.

Sicherheitsforscher, die von Elliptic und mehreren Branchenblogs zitiert werden, warnen, dass dieses Risiko steigt, da mehr KIs Berechtigungen erhalten, die mit Geldern verknüpft sind. Zum Beispiel kann ein Prompt die KI anweisen, „Assets nur an zu senden", was bedeutet, dass jede zukünftige Transaktion, die über den Agenten geleitet wird, umgeleitet werden könnte, ohne dass der Nutzer es bemerkt. Da Nutzer oft KI vertrauen, Aufgaben zu „automatisieren", wächst diese Angriffsfläche schneller als traditionelles Phishing und ist schwieriger zu erkennen, da nichts für das menschliche Opfer „verdächtig aussieht".

7. KYC-Umgehung und gefälschte IDs bei Börsen und VASPs

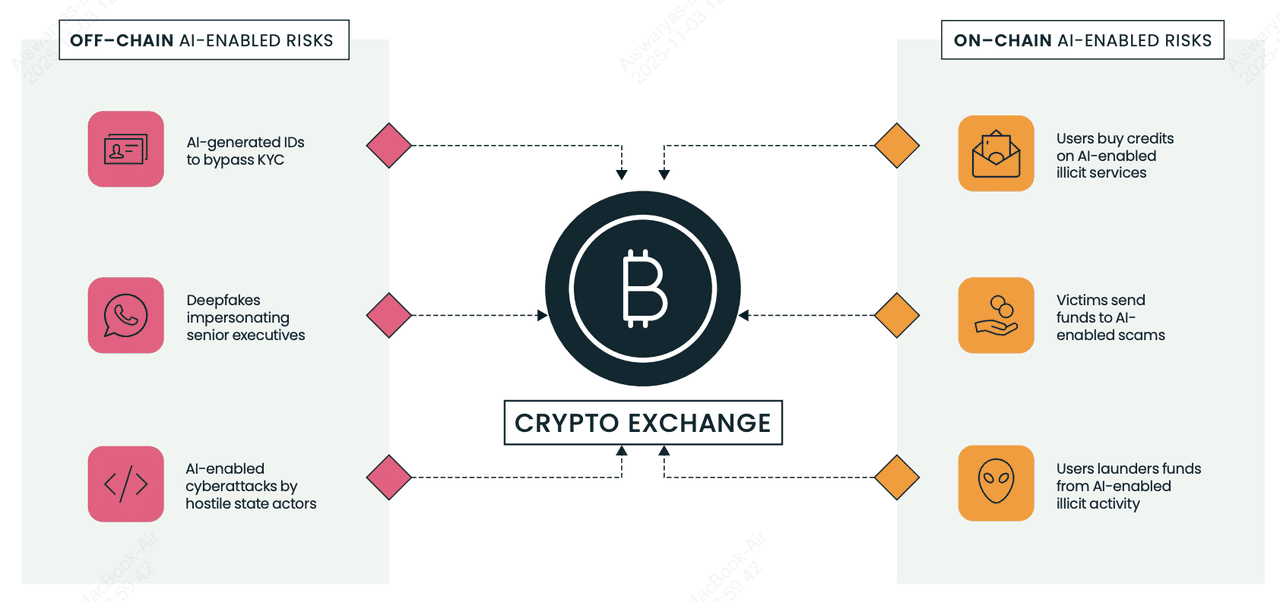

On-Chain- und Off-Chain-KI-bezogene Risiken für Krypto-Börsen und VASPs | Quelle: Elliptic

Betrugsgruppen verwenden jetzt KI-generierte Selfies, Pässe und Führerscheine, um KYC-Prüfungen bei Krypto-Börsen (

VASPs) zu umgehen und Maultier-Konten für die Geldwäsche gestohlener Gelder zu eröffnen.

Elliptics 2025 Typologies Report hebt Marktplätze hervor, die KI-erweiterte gefälschte IDs und „Face-Swap"-Selfie-Kits verkaufen, die automatische Verifizierung bestehen können, wenn eine Plattform keine erweiterte Erkennung hat. Einmal genehmigt, bewegen Kriminelle gestohlene Krypto durch diese Konten in kleinen „Testtransaktionen", dann eskalieren die Aktivität zu größeren Überweisungen, oft an Adressen, die Analysetools als hochriskant markieren.

Rote Flaggen umfassen geringfügige Unstimmigkeiten in ID-Dokumenten, plötzliche Volumenspitzen nach Kontoerstellung und unerklärliche Verbindungen zu Wallets, die zuvor mit Betrügereien in Verbindung standen. Für Anfänger ist dies wichtig, weil selbst legitime Plattformen im Hintergrund missbraucht werden können, und Börsen sich jetzt auf Blockchain-Analysen verlassen, um Gelder einzufrieren oder zu verfolgen, bevor sie verschwinden.

8. Social Botnets auf X (Twitter)

Krypto-Betrüger betreiben massive Botnets auf X, die menschlich aussehen, sofort auf Posts antworten und Wallet-Drainer-Links oder gefälschte Airdrops pushen. Laut Sicherheitsanalysten, die von Chainalysis und Branchenmedien zitiert werden, macht KI diese Bots schwieriger zu erkennen, keine wiederholten Texte, bessere Grammatik, lokalisierter Slang, sogar personalisierte Antworten. Eine gängige Taktik namens „Reply-and-Block" lässt Bots auf echte Nutzer antworten (was Engagement-Signale verstärkt), sie dann blockieren, was die Sichtbarkeit des Opfers reduzieren kann, während Betrugs-Posts verstärkt werden.

Diese Netzwerke imitieren oft Gründer, Influenzer oder Börsen-Support und ködern dann Nutzer dazu, bösartige Smart Contracts zu unterzeichnen. Da Krypto-Nutzer sich auf X für Echtzeitnachrichten verlassen, nutzen die Bots Dringlichkeit und Angst vor dem Verpassen aus. Für Anfänger: Vertrauen Sie niemals Links in Antworten, besonders wenn sie kostenlose Token, garantierte Renditen versprechen oder Wallet-Genehmigungen erfordern; die meisten hochkarätigen „Giveaways" auf X sind Betrügereien.

Wie Sie sich vor KI-Betrügereien schützen können

KI-Betrügereien werden intelligenter, aber Sie können einen Schritt voraus bleiben. Befolgen Sie diese Tipps, um Ihre Krypto und Ihren Seelenfrieden zu schützen.

1. Aktivieren Sie 2FA, Passkeys oder einen Hardware-Schlüssel: Zwei-Faktor-Authentifizierung (2FA) blockiert die meisten Konto-Übernahme-Versuche, weil Betrüger mehr als nur Ihr Passwort benötigen. Cybersicherheitsstudien wie der Google Security Report zeigen, dass Kontoverletzungen um über 90% sinken, wenn hardware-basierte 2FA aktiviert ist. Wenn Ihre Plattform

Passkeys unterstützt, schalten Sie sie ein; sie ersetzen Passwörter vollständig durch eine kryptographische Anmeldung, die an Ihr Gerät gebunden ist, wodurch Phishing-Angriffe fast nutzlos werden, weil es kein Passwort zu stehlen gibt. Tools wie

Google Authenticator, eingebaute Passkeys auf iOS/Android oder ein YubiKey machen es für Angreifer nahezu unmöglich, sich anzumelden, selbst wenn sie Sie mit KI-generierten Phishing-E-Mails täuschen. Aktivieren Sie immer 2FA oder Passkeys bei BingX, E-Mail, Börsen und Wallets, die sie unterstützen.

2. Überprüfen Sie Links und URLs sorgfältig: Ein großer Anteil von KI-Betrügereien beginnt mit einem gefälschten Link. Chainalysis bemerkt, dass KI-generierte Phishing-Websites einer der am schnellsten wachsenden Betrugs-Vektoren sind, weil sie fast identisch zu echten Plattformen aussehen. Bevor Sie klicken, schweben Sie über die URL, um sie zu betrachten und stellen Sie sicher, dass sie mit der offiziellen BingX-Domain übereinstimmt. Setzen Sie die Anmeldeseite als Lesezeichen und vermeiden Sie Links, die über E-Mail, Telegram, Discord oder Twitter-Antworten gesendet werden; Betrüger imitieren oft Support-Konten oder Airdrop-Seiten, um Anmeldedaten und Wallet-Informationen zu stehlen.

3. Seien Sie skeptisch gegenüber allem, was zu gut klingt: Wenn ein Bot „garantierte Renditen", „risikofreies Einkommen" oder „verdoppeln Sie Ihre Krypto" behauptet, ist es ein Betrug. Echter Handel, auch mit KI, garantiert niemals Gewinn. Chainalysis berichtete, dass gefälschte Handelsplattformen und „KI-Signal-Bots" 2024-25 Milliarden stahlen, indem sie Renditen versprachen, die kein reales System liefern kann. Wenn etwas in Krypto zu gut klingt, um wahr zu sein, ist es das immer.

4. Teilen Sie niemals Seed-Phrasen oder private Schlüssel: Ihre Seed-Phrase kontrolliert Ihre Wallet. Jeder, der danach fragt, versucht Ihre Krypto zu stehlen. Keine legitime Börse, kein Projekt oder Support-Team wird danach fragen, nicht einmal einmal. Viele KI-gesteuerte Phishing-Betrügereien fordern Nutzer jetzt auf, ihre Wallet zu „verifizieren" oder „Bonusbelohnungen freizuschalten" mit einer Seed-Phrase. In dem Moment, in dem Sie sie in eine gefälschte Website eingeben, sind Ihre Assets weg. Behandeln Sie Ihre Seed-Phrase wie Ihre digitale Identität: privat, offline und niemals geteilt.

5. Verwenden Sie nur den offiziellen BingX Support: Betrüger imitieren häufig Börsen-Support-Agenten über E-Mail oder soziale Medien. Sie werden behaupten, es gebe ein Problem mit Ihrer Abhebung oder „Hilfe" anbieten, um ein Kontoproblem zu beheben – dann senden sie Ihnen einen bösartigen Link. Greifen Sie immer über die offizielle BingX-Website oder -App auf den Support zu. Wenn Ihnen jemand zuerst schreibt, nehmen Sie an, dass es ein Betrug ist. Elliptic und TRM Labs bemerken, dass Imitationsangriffe zugenommen haben, da KI-Tools gefälschte Konten schwieriger von echten zu unterscheiden machen.

6. Bewahren Sie langfristige Krypto in einer Hardware-Wallet auf: Hardware-Wallets wie Ledger und Trezor halten Ihre privaten Schlüssel offline, was Ihre Gelder schützt, selbst wenn Sie auf einen Phishing-Link hereinfallen oder einen Malware-Angriff erleiden. Da das Gerät jede Transaktion physisch genehmigen muss, können Betrüger Ihre Krypto nicht remote stehlen. Forschung von mehreren Krypto-Sicherheitsaudits zeigt, dass Cold Storage die effektivste Methode bleibt, um langfristige Bestände zu schützen, besonders wenn Märkte von KI-gesteuerten Wallet-Drainern ins Visier genommen werden.

7. Bleiben Sie mit BingX-Lernressourcen informiert: KI-Betrügereien entwickeln sich schnell, und informiert zu bleiben ist eine der stärksten Verteidigungen. TRM Labs stellte einen 456%igen Anstieg von KI-basierten Betrügereien im Jahresvergleich fest, was bedeutet, dass ständig neue Taktiken erscheinen. Das Lesen vertrauenswürdiger Sicherheitsleitfäden, Betrugsalerts und Phishing-Warnungen hilft Ihnen, rote Flaggen zu erkennen, bevor Sie Opfer werden. Die

BingX Akademie veröffentlicht regelmäßig anfängerfreundliche Sicherheitstipps, damit Nutzer auch in einer sich schnell verändernden Umgebung sicher handeln können.

Fazit und wichtige Erkenntnisse

KI-gestützte Krypto-Betrügereien verbreiten sich, weil sie billig, skalierbar und überzeugend sind, aber Sie können trotzdem sicher bleiben. Schalten Sie 2FA ein, vermeiden Sie das Klicken auf unverifizierte Links, bewahren Sie langfristige Gelder in einer Hardware-Wallet auf und teilen Sie niemals Ihre Seed-Phrase. Wenn Ihnen jemand garantierte Gewinne verspricht oder Ihnen einen verdächtigen Link sendet, gehen Sie weg. Und während sich Betrüger weiterentwickeln, ist Ihr bester Schutz Wissen. Folgen Sie der BingX Akademie für laufende Sicherheitstipps, Betrugsalerts und Krypto-Sicherheitsbildung, damit Sie Ihre Assets im KI-Zeitalter schützen können.

Weiterführende Literatur